八股文-数据库

mysql

【问题】 MySQL 中四种隔离级别分别是什么?

【参考答案】 MySQL 数据库中定义的四种事务隔离级别(Transaction Isolation Levels)用于解决并发事务带来的问题:

- 读未提交 (READ UNCOMMITTED):

- 特点:事务可以读取到其他事务未提交的数据修改。

- 问题:存在 脏读 (Dirty Read),即读取到了最终可能回滚的无效数据。

- 读已提交 (READ COMMITTED):

- 特点:事务只能读取到其他事务已经提交的数据。

- 问题:解决了脏读,但存在 不可重复读 (Non-Repeatable Read),即在同一个事务内多次读取同一条记录,结果可能不一致。

- 可重复读 (REPEATABLE READ):

- 特点:保证在同一个事务内,多次读取同一条记录的结果是一致的。

- 地位:MySQL InnoDB 存储引擎的 默认隔离级别。

- 可串行化 (SERIALIZABLE):

- 特点:最高的隔离级别。通过强制事务排序,使之不可能相互冲突。

- 代价:在每个读数据行上加上共享锁,性能最低。

【延伸考点讲解】

- 并发问题总结:脏读(读取未提交数据)、不可重复读(读取已提交的更新数据)、幻读(读取已提交的新插入数据)。

- 幻读 (Phantom Read) 与 MVCC:InnoDB 在“可重复读”级别下,通过 MVCC (多版本并发控制) 和 Next-Key Locks (间隙锁) 已经在很大程度上解决了幻读问题,这是它与标准 SQL 定义的区别。

- 隔离级别与性能的权衡:隔离级别越高,数据一致性越好,但系统的并发性能越差。在实际开发中,通常根据业务场景选择

READ COMMITTED(大多数数据库默认)或REPEATABLE READ(MySQL 默认)。

【问题】 SQL 之连接查询(左连接和右连接的区别)?

【参考答案】 连接查询是 SQL 中将多张表的数据结合在一起的基础操作。常见的连接方式如下:

- 左连接 (LEFT JOIN):

- 逻辑:以左表为基准,返回左表的所有记录。

- 结果:如果右表中有匹配项,则显示对应数据;如果没有匹配项,右表的字段显示为

NULL。

- 右连接 (RIGHT JOIN):

- 逻辑:以右表为基准,返回右表的所有记录。

- 结果:如果左表中有匹配项,则显示对应数据;如果没有匹配项,左表的字段显示为

NULL。

- 内连接 (INNER JOIN):

- 逻辑:只返回两张表中完全匹配(满足连接条件)的行。

- 全连接 (FULL JOIN):

- 逻辑:返回左右两表中的所有记录。匹配的行合并显示,不匹配的行显示

NULL。 【延伸考点讲解】

- 逻辑:返回左右两表中的所有记录。匹配的行合并显示,不匹配的行显示

- 性能与习惯:在实际开发中,左连接 的使用频率远高于右连接。绝大多数右连接都可以通过交换表顺序改为左连接,这样代码逻辑更符合从左到右的阅读习惯。

- MySQL 对全连接的支持:MySQL 原生并不支持

FULL JOIN关键字。如果需要实现全连接,通常使用LEFT JOIN和RIGHT JOIN配合UNION关键字来实现。 - 驱动表与被驱动表:连接查询时,基准表被称为“驱动表”,另一张表称为“被驱动表”。合理选择驱动表并结合索引,是 SQL 调优的关键。

【问题】 left join on 后面加条件与 where 后面加条件与 group by having 后加条件的区别?

【参考答案】 这三者在 SQL 执行流程中的阶段不同,导致了过滤效果的差异:

- ON 条件:

- 阶段:在生成连接中间表(Join)时执行。

- 效果:如果是

LEFT JOIN,即使ON中的条件为假,左表的记录也 一定会 返回,只是对应的右表字段为NULL。

- WHERE 条件:

- 阶段:在临时表生成之后执行的过滤。

- 效果:它对连接后的结果集进行筛选。如果

WHERE条件不满足,整行记录(包括左表数据)都会被剔除,此时LEFT JOIN的“保留左表”特性会失效。

- HAVING 条件:

- 阶段:在

GROUP BY分组计算之后执行。 - 效果:专门用于过滤分组后的聚合结果(如

COUNT(*) > 1),不能直接用于过滤原始行。 【延伸考点讲解】

- 阶段:在

- 执行顺序:

FROM->ON->JOIN->WHERE->GROUP BY->HAVING->SELECT->ORDER BY。 - 性能优化:尽量将过滤条件放在

ON或WHERE中,而不是HAVING,因为早期的过滤可以减少后续处理的数据量。 - 逻辑陷阱:在使用

LEFT JOIN时,如果误将右表的筛选条件放在WHERE中,可能会导致查询结果退化为INNER JOIN的效果。

【问题】 数据库三范式是什么?

【参考答案】 数据库范式(Normal Form)是设计关系型数据库时需要遵循的规范,旨在减少数据冗余和改善数据完整性:

- 第一范式 (1NF):

- 核心:原子性。要求表中的每个字段都是不可再分的最小数据单位。

- 第二范式 (2NF):

- 核心:完全函数依赖。在满足 1NF 的基础上,要求表中的非主键列必须完全依赖于主键,而不能只依赖于主键的一部分(针对复合主键而言)。

- 第三范式 (3NF):

- 核心:消除传递依赖。在满足 2NF 的基础上,要求表中的非主键列必须直接依赖于主键,不能存在传递依赖(即非主键列 A 依赖于非主键列 B,而 B 依赖于主键)。

【延伸考点讲解】

- 设计目标:范式化的主要目的是消除数据冗余,从而减少数据插入、更新和删除时的异常。

- 反范式化 (Denormalization):在实际的高性能数据库设计中,有时为了提高查询效率(减少多表关联 Join 操作),会刻意违反范式,增加一定的冗余字段。

- 范式级别:除了前三范式,还有 BCNF(鲍依斯-科德范式)、第四范式、第五范式等,但在绝大多数商业应用设计中,达到第三范式即被认为是合理的。

【问题】 SQL 语句的关键词执行顺序是怎样的?

【参考答案】 理解 SQL 的逻辑执行顺序对于编写高效的查询至关重要。其标准执行顺序如下:

- FROM:从指定的数据源(表或视图)加载数据。

- ON:执行连接条件过滤。

- JOIN:进行表连接操作。

- WHERE:对原始行数据进行初步筛选。

- GROUP BY:将结果集划分为多个分组。

- 聚合函数:执行

COUNT,SUM,AVG等计算。 - HAVING:对分组后的结果进行二次筛选。

- SELECT:选择要显示的列,执行计算表达式。

- DISTINCT:对结果集进行去重。

- ORDER BY:对最终结果进行排序。

- LIMIT / OFFSET:进行分页截断。

简记: FROM -> WHERE -> GROUP BY -> HAVING -> SELECT -> ORDER BY -> LIMIT。

【延伸考点讲解】

- 别名的使用限制:为什么

WHERE中不能直接使用SELECT中定义的别名?因为在执行WHERE时,SELECT尚未执行,别名还未定义。而ORDER BY却可以使用别名。 - 性能优化:由于

WHERE在GROUP BY之前执行,而HAVING在其之后,因此应尽可能将过滤条件写在WHERE中,以减少参与分组和聚合的数据量。 - 执行引擎差异:虽然逻辑执行顺序是标准的,但数据库查询优化器(Optimizer)在实际执行时可能会根据索引和统计信息调整物理执行路径。

函数

【问题】 SQL 中聚合函数有哪些?

【参考答案】 聚合函数(Aggregate Functions)是对一组值进行计算并返回单个汇总值的函数。它们通常与 GROUP BY 子句配合使用。常用的聚合函数包括:

- AVG():返回数值列的平均值。空值(NULL)会被忽略。

- COUNT():返回匹配条件的行数。

COUNT(*)统计总行数,COUNT(column)统计非空值的行数。 - MAX():返回指定列中的最大值。

- MIN():返回指定列中的最小值。

- SUM():返回数值列的总和。空值会被忽略。

【延伸考点讲解】

- NULL 值的处理:除了

COUNT(*)之外,大多数聚合函数都会自动忽略NULL值。在计算平均值时,NULL不会计入分母。 - DISTINCT 的使用:聚合函数可以配合

DISTINCT关键字使用,例如COUNT(DISTINCT city)将统计不重复的城市数量。 - WHERE 与 HAVING 的配合:

WHERE用于在聚合前过滤行,而HAVING用于在聚合后过滤组。例如:SELECT department, AVG(salary) FROM employees WHERE age > 30 GROUP BY department HAVING AVG(salary) > 5000;

【问题】 在 MySQL 中,怎么存储 IP 地址?

【参考答案】 在 MySQL 中存储 IP 地址,应优先考虑性能和存储空间的平衡:

- IPv4 存储:

- 推荐方案:使用 32位无符号整数 (UNSIGNED INT)。

- 理由:仅占用 4 字节,比字符串存储(需 15 字节以上)节省空间,且索引查询速度更快。

- 转换函数:

INET_ATON()(字符串转数字)和INET_NTOA()(数字转字符串)。

- IPv6 存储:

- 推荐方案:使用 VARBINARY(16)。

- 理由:IPv6 地址为 128 位,占用 16 字节。

- 转换函数:

INET6_ATON()和INET6_NTOA()。

【延伸考点讲解】

- 为什么不用 VARCHAR?:虽然

VARCHAR(15)更直观,但它需要额外的 1 字节存储长度,实际占用可达 16 字节,且在进行范围查询(如 CIDR 匹配)时性能远低于整数。 - 转换示例:

SELECT INET_ATON('192.168.1.1');-> 返回3232235777SELECT INET_NTOA(3232235777);-> 返回'192.168.1.1'

- 架构建议:在高性能场景下,不仅是 IP 地址,对于具有固定长度或可数值化的标识符,都应优先考虑使用定长数值类型存储。

存储引擎

【问题】 MyISAM 存储引擎了解吗?

【参考答案】 MyISAM 是 MySQL 5.5 之前的默认存储引擎。它的设计目标是快速读取,但在并发写入和数据安全性方面较弱。

- 锁机制:仅支持 表级锁 (Table-level Locking)。读操作加共享锁,写操作加排他锁。高并发写入时容易产生严重的性能瓶颈。

- 事务支持:不支持事务,也不支持崩溃后的安全恢复。

- 存储结构:每张表在磁盘上存储为三个文件:

.frm(表结构)、.MYD(数据)、.MYI(索引)。 - 索引特性:支持 全文索引 (FULLTEXT)(MySQL 5.6 之前唯一支持全文索引的引擎)。索引采用 B-Tree 结构,且是非聚集索引(数据与索引分离)。

- 统计信息:内置计数器存储了表的总行数,因此

count(*)操作极快。

【延伸考点讲解】

- 聚集索引 vs 非聚集索引:MyISAM 是非聚集索引,索引文件(.MYI)存储的是指向数据文件(.MYD)中物理地址的指针。

- 适用场景:适用于读多写极少、对事务无要求、追求极致查询速度或需要全文搜索的场景(如日志表、报表分析、只读内容系统)。

- 数据完整性:由于不支持事务和外键,数据的完整性必须由应用程序逻辑来保证。

【问题】 InnoDB 存储引擎了解吗?

【参考答案】 InnoDB 是 MySQL 5.5 之后默认的存储引擎,是目前应用最广泛的事务型引擎:

- 事务支持:完全支持 ACID 事务,支持提交、回滚和崩溃恢复能力。

- 锁机制:支持 行级锁 (Row-level Locking),大大提高了多用户并发性能。

- 并发控制:通过 MVCC (多版本并发控制) 实现了非锁定读,减少了锁冲突。

- 数据存储:采用 聚集索引 (Clustered Index) 组织表,数据文件与主键索引绑定在一起,通过主键查询效率极高。

- 数据完整性:支持 外键 (Foreign Key) 约束。

【延伸考点讲解】

- 聚集索引 vs 辅助索引:InnoDB 的数据实际上存储在主键索引的叶子节点上。辅助索引(二级索引)的叶子节点存储的是主键值,因此通过辅助索引查询通常需要“回表”。

- Buffer Pool:InnoDB 拥有独立的缓冲池,不仅缓存索引,也缓存真实数据,这是它性能优于 MyISAM 的关键之一。

- 幻读解决:通过 Next-Key Locks(行锁 + 间隙锁)算法,InnoDB 在“可重复读”隔离级别下成功解决了幻读问题。

- 统计信息:与 MyISAM 不同,InnoDB 不存储表的总行数,执行

count(*)需要扫描索引或全表。

【问题】 MySQL 的存储引擎有哪些?它们之间有什么区别?

【参考答案】 MySQL 支持多种存储引擎,核心区别如下:

- InnoDB(MySQL 5.5+ 默认):支持事务(ACID)、行级锁、MVCC、外键、崩溃恢复。适合高并发 OLTP。

- MyISAM:不支持事务和行级锁,仅表级锁。读写速度快,支持全文索引。适合读多写少场景。

- Memory:数据全部存储在内存中,默认使用哈希索引。速度极快但数据易失,适合临时表。

- Archive:仅支持 INSERT 和 SELECT,使用 zlib 压缩存储。适合日志归档。

- CSV:以 CSV 格式存储,可直接与 Excel 交换数据,但不支持索引。

| 特性 | InnoDB | MyISAM | Memory |

|---|---|---|---|

| 事务 | ✅ | ❌ | ❌ |

| 锁粒度 | 行锁 | 表锁 | 表锁 |

| 外键 | ✅ | ❌ | ❌ |

| 崩溃恢复 | ✅ | ❌ | ❌ |

| MVCC | ✅ | ❌ | ❌ |

【大白话解释】 存储引擎就像不同的文件柜:InnoDB 是保险柜,有锁有密码,东西安全但存取稍慢;MyISAM 是普通文件柜,谁都能翻开看,拿取方便但不安全;Memory 是办公桌上的托盘,拿取最快但一断电东西就没了。

【扩展知识点详解】

- 查看引擎:

SHOW ENGINES;查看当前 MySQL 支持的所有引擎及默认引擎。 - 指定引擎:

CREATE TABLE ... ENGINE=InnoDB;,也可通过ALTER TABLE修改。 - 混合引擎限制:同一事务中操作不同引擎的表可能导致回滚不完整。

【问题】 MySQL InnoDB 引擎中的聚簇索引和非聚簇索引有什么区别?

【参考答案】

- 聚簇索引(Clustered Index):数据行的物理存储顺序与索引顺序一致。InnoDB 中主键索引就是聚簇索引,叶子节点直接存储完整的行数据。每张表只能有一个聚簇索引。查询主键时无需回表,效率最高。

- 非聚簇索引(二级索引):叶子节点存储索引列的值和对应的主键值,而非完整行数据。查询时如果需要非索引列,必须通过主键值回表到聚簇索引获取完整数据。一张表可以有多个二级索引。主键越长,二级索引越大。

【大白话解释】 聚簇索引就像一本按拼音排序的字典,字和解释就在索引所在的位置,翻到索引就翻到了内容。非聚簇索引就像字典后面的偏旁部首索引,告诉你字在哪个页码,你还得翻到那页才能看到解释(回表)。

【扩展知识点详解】

- 主键自增建议:自增主键保证数据顺序插入,避免频繁的页分裂;UUID 等随机主键会导致插入位置随机,引发大量页分裂。

- 无主键时:InnoDB 会选择第一个非空唯一索引作为聚簇索引;若都没有,则生成隐藏的 6 字节 row_id。

- MyISAM 的区别:MyISAM 没有聚簇索引,所有索引叶子节点存储数据行的物理地址指针。

优化

【问题】 MySQL 怎样优化分页查询?

【参考答案】 当数据量巨大时,传统的 LIMIT offset, rows 分页方式会随着 offset 的增大而变得极其缓慢,因为数据库需要扫描并丢弃前面的所有行。优化方案包括:

- 基于主键的范围查询:

- 逻辑:如果主键是自增且连续的,记录上一次查询的最大 ID,下次查询时直接定位。

- 示例:

SELECT * FROM table WHERE id > 10000 LIMIT 10; - 优点:直接定位,性能极佳。

- 子查询优化(延迟关联):

- 逻辑:先通过子查询利用覆盖索引找到目标主键,再回表获取完整记录。

- 示例:

SELECT * FROM table t1 JOIN (SELECT id FROM table ORDER BY id LIMIT 10000, 10) t2 ON t1.id = t2.id; - 优点:减少了回表次数和数据扫描量。

- 覆盖索引:

- 逻辑:如果查询的字段全部包含在索引中,则无需回表,直接从索引中返回结果。

【延伸考点讲解】

- 深度分页瓶颈:深分页(如

LIMIT 1000000, 10)的本质问题是 MySQL 需要读取 1,000,010 条记录,然后丢弃前 1,000,000 条,造成巨大的磁盘 I/O 和内存浪费。 - 业务层面规避:对于极深的分页,可以考虑限制用户的翻页深度(如只允许翻前 100 页),或者采用“下一页”模式(类似微博、抖音的无限滚动,记录上一个游标值)。

- 搜索引擎辅助:对于海量数据的复杂分页查询,通常建议将其同步到 Elasticsearch 等全文检索引擎中处理。

【问题】 SQL 之 SQL 注入是什么?

【参考答案】 SQL 注入(SQL Injection)是一种常见的网络安全漏洞。攻击者通过在 Web 表单输入、URL 参数或 HTTP 请求中插入恶意的 SQL 代码,欺骗数据库服务器执行非预期的指令。

- 核心原理:由于应用程序没有对用户输入进行严格的校验和过滤,直接将输入拼接到 SQL 语句中执行。

- 典型危害:绕过身份验证、窃取敏感数据(如用户密码)、非法篡改或删除数据库记录,甚至通过数据库权限获取服务器控制权。

- 示例:查询语句原本为

SELECT * FROM user WHERE username = '+ 用户输入 +'。若攻击者输入' OR '1'='1,SQL 将变为SELECT * FROM user WHERE username = '' OR '1'='1',导致WHERE条件恒成立,从而绕过登录。

【延伸考点讲解】

- 注入类型:包括报错注入、布尔盲注、时间盲注(基于延迟)、联合查询注入(UNION)等。

- 防御关键:永远不要相信用户的输入。必须对用户输入进行严格的合法性校验、特殊字符转义,或者最根本地使用 预编译语句 (Prepared Statements)。

- 辅助工具:开发者常用的自动化漏洞检测工具有 sqlmap。

【问题】 防止 SQL 注入的方式?

【参考答案】 预防 SQL 注入的核心原则是“数据与指令分离”。主要方式包括:

- 使用预编译语句 (Prepared Statements):

- 原理:SQL 模板先发送到数据库编译,之后传入的参数仅被视为纯数据,不会被解析为 SQL 指令。

- 示例:JDBC 中的

PreparedStatement。

- 使用 ORM 框架的安全特性:

- MyBatis:优先使用

#{}占位符(底层即预编译),避免使用${}(直接拼接)。 - Hibernate/JPA:使用命名参数查询。

- MyBatis:优先使用

- 严格的输入校验与转义:

- 对用户输入进行类型检查(如 ID 必须是数字)、长度限制及特殊字符转义(如单引号、分号等)。

- 最小权限原则:

- 数据库账号仅赋予执行业务所需的最小权限,禁止 Web 应用使用

root或db_owner权限连接数据库。

- 数据库账号仅赋予执行业务所需的最小权限,禁止 Web 应用使用

【延伸考点讲解】

- #{} vs ${}:在 MyBatis 中,

#{}会将参数部分替换为?,而${}是直接进行字符串替换,后者极易引发 SQL 注入。但在某些动态场景(如动态表名、排序字段ORDER BY)中不得不使用${}时,必须手动进行白名单过滤。 - 存储过程安全:虽然存储过程也是预编译的,但如果在存储过程内部使用了动态 SQL 拼接,依然可能存在注入风险。

- WAF (Web Application Firewall):在网络层部署 Web 应用防火墙,可以拦截大部分常见的注入攻击。

【问题】 MySQL 性能优化有哪些?

【参考答案】 MySQL 性能优化可以从多个维度入手,包括 SQL 语句优化、索引优化、数据库架构设计等:

- SQL 语句优化:

- 精准查询:避免使用

SELECT *,仅返回必要的字段,减少网络带宽消耗 and 内存占用。 - 限制返回量:如果已知只查询一行,使用

LIMIT 1,引擎在找到后会立即停止扫描。 - 避免全表扫描:避免在

WHERE子句中对字段进行NULL值判断、函数操作或开头模糊查询(如LIKE '%abc'),这些都会导致索引失效。 - 子查询优化:优先使用

EXISTS或JOIN代替IN/NOT IN,因为前者更能有效利用索引。

- 精准查询:避免使用

- 索引优化:

- 覆盖索引:尽量使查询条件和返回字段都在索引中,避免“回表”。

- 合理建立索引:为高频搜索、排序、分组的字段建立索引,但避免过度索引。

- 架构与配置优化:

- 选择合适的引擎:事务型应用首选

InnoDB(行锁、事务支持);读密集且无事务要求可考虑MyISAM。 - 字段类型优化:使用最精确的类型,如存储 IP 使用

INT而非VARCHAR。

- 选择合适的引擎:事务型应用首选

【延伸考点讲解】

- 执行计划 (EXPLAIN):这是性能优化的神器。通过

EXPLAIN查看 SQL 的执行路径,关注type(连接类型,ref/range优于ALL)和key(是否命中索引)。 - 慢查询日志 (Slow Query Log):开启慢查询日志记录执行时间超过阈值的 SQL,是定位系统性能瓶颈的首要步骤。

- 读写分离与分库分表:当单机性能达到上限时,可以通过主从复制实现读写分离,或者通过垂直/水平拆分(分库分表)来分散存储压力。

【问题】 有哪些数据库优化方面的经验?

【参考答案】 在实际项目开发中,数据库优化通常遵循“由易到难、由局部到整体”的原则:

- 语句级别:优先使用

PreparedStatement。它不仅能防止 SQL 注入,且数据库会对预编译语句进行缓存,在重复执行时性能更高。 - 设计级别:

- 慎用外键:外键约束会显著降低插入和删除的性能。在高性能互联网应用中,通常去掉数据库层面的外键,由程序逻辑保证数据完整性。

- 适当冗余:为了减少高频的

JOIN查询,可以适当违反范式,在表中增加冗余字段(如“回复数”、“最后更新时间”)。

- 操作选择:使用

UNION ALL代替UNION。如果业务能保证数据不重复且无需排序,UNION ALL不会进行去重和排序操作,执行效率远高于UNION。 - 事务控制:尽量缩短事务的生命周期,避免在事务中进行远程网络调用或耗时较长的业务逻辑,以减少行锁锁定时间。

【延伸考点讲解】

- 反范式化权衡:冗余字段虽然提高了查询速度,但增加了数据维护的复杂度(更新时需要同步更新多处)。

- 索引维护:索引并非越多越好。插入、删除、更新操作都需要维护索引。应定期清理长期未被使用的无效索引。

- 批量操作:在大量插入数据时,应使用批量插入(Batch Insert)而非循环单条插入,以减少与数据库的交互次数。

【问题】 一张表,里面有 ID 自增主键,当 insert 了 17 条记录之后,删除了第 15, 16, 17 条记录,再把 MySQL 重启,再 insert 一条记录,这条记录的 ID 是 18 还是 15 ?

【参考答案】 这个问题的答案取决于使用的 存储引擎 以及 MySQL 的版本:

- MyISAM 引擎:

- 结果:ID 是 18。

- 原理:MyISAM 会将自增主键的最大 ID 记录在数据文件(.MYI)中,重启后依然能从磁盘读取到该值。

- InnoDB 引擎:

- MySQL 5.7 及以前版本:ID 是 15。

- 原理:自增计数器(Auto-increment Counter)仅存储在内存中。重启后,InnoDB 会执行类似

SELECT MAX(id) FROM table FOR UPDATE的语句来重新初始化计数器。由于 15, 16, 17 已被删除,表中最大 ID 为 14,因此新插入的 ID 为 15。 - MySQL 8.0 及以后版本:ID 是 18。

- 原理:8.0 版本将自增计数器的变化记录在了重做日志(Redo Log)中,实现了持久化,重启后不会丢失。

【延伸考点讲解】

- 自增空洞:在任何版本中,如果事务回滚(Rollback)或者插入失败,已经消耗掉的自增 ID 都不会被回收,这会导致 ID 序列中出现“空洞”。

- AUTO_INCREMENT 初始化:可以通过

ALTER TABLE table_name AUTO_INCREMENT = N;手动设置下一个自增 ID 的起始值。 - 并发性能:InnoDB 使用专门的“自增锁”(AUTO-INC Locking)来保证并发插入时 ID 的唯一性,在大规模并发写入时,这可能成为一个微小的性能瓶颈。

【问题】 在 MySQL 中 ENUM 的用法是什么?

【参考答案】 ENUM 是 MySQL 中的一种字符串对象,允许在创建表时定义一组预定义的允许值。

- 基本语法:

col_name ENUM('value1', 'value2', 'value3') - 存储机制:内部使用整数(1, 2, 3…)来存储,每个值对应一个索引。这使得它比直接存储字符串更节省空间。

- 约束作用:插入的值必须是定义好的枚举成员之一(如果不符合,在非严格模式下存入空字符串,严格模式下报错)。

【延伸考点讲解】

- 性能优势:由于内部存储为整数,处理速度快且占用空间小(1 到 255 个成员占 1 字节,256 到 65535 个占 2 字节)。

- 主要缺点:

- 修改成本高:增加或删除枚举成员通常需要

ALTER TABLE,在海量数据表上非常耗时。 - 排序陷阱:默认按索引号(定义的顺序)排序,而不是按字母顺序。

- 修改成本高:增加或删除枚举成员通常需要

- 最佳实践:对于值极少变动且范围固定的字段(如性别

'male', 'female'),可以使用ENUM;对于变动频繁的业务维度,建议使用关联表或在应用层控制。

【问题】 CHAR 和 VARCHAR 的区别?

【参考答案】 CHAR 和 VARCHAR 是 MySQL 中最常用的两种字符串类型,它们的主要区别在于存储方式、长度限制和性能:

- 存储方式:

- CHAR:定长字符串。存储时,如果内容不足定义长度,会用空格填充。检索时,会自动删除尾部空格。

- VARCHAR:变长字符串。仅存储实际内容长度(外加 1-2 字节用于记录长度),不会填充空格。

- 长度限制:

- CHAR:最大长度为 255 字符。

- VARCHAR:最大长度理论上为 65535 字节(受行最大大小限制)。

- 性能表现:

- CHAR:由于是定长的,数据库引擎处理速度更快,不存在碎片问题。

- VARCHAR:由于是变长的,在更新时如果内容变长,可能导致行拆分(Row Split),产生碎片,性能略低。

【延伸考点讲解】

- 适用场景:

- CHAR:适用于长度非常固定的字段,如 MD5 摘要、身份证号、手机号、性别等。

- VARCHAR:适用于长度波动较大的字段,如评论、地址、个人简介等。

- 存储空间计算:

VARCHAR(N)在存储时,如果 $N \le 255$,需要额外 1 字节记录长度;如果 $N > 255$,需要 2 字节。 - 尾部空格处理:这是一个经典陷阱。

CHAR在检索时会丢弃尾部空格,而VARCHAR(在 MySQL 5.0.3 之后)会保留尾部空格。

【问题】 如果一个表有一列定义为 TIMESTAMP,将发生什么?

【参考答案】 TIMESTAMP 列具有自动初始化和自动更新的特性,具体行为取决于创建表时的定义:

- 自动更新:默认情况下,如果未显式指定值,第一个

TIMESTAMP列会在行被插入时设置为当前时间,并且在行数据发生更改时,自动更新为当前时间(ON UPDATE CURRENT_TIMESTAMP)。 - 存储范围:其范围是

'1970-01-01 00:00:01' UTC到'2038-01-19 03:14:07' UTC。 - 时区相关:存储时会从当前时区转换为 UTC,检索时再转换回当前时区。

【延伸考点讲解】

- 与 DATETIME 的区别:

DATETIME占用 8 字节(5.6 后 5 字节),范围更广(1000-9999年),且与时区无关;TIMESTAMP仅占 4 字节,空间效率更高,但受“2038年问题”限制。 - 显式控制:可以通过定义

DEFAULT CURRENT_TIMESTAMP和ON UPDATE CURRENT_TIMESTAMP来精确控制初始化和更新行为。 - 2038年问题:由于

TIMESTAMP使用 32 位整数存储秒数,将在 2038 年溢出。对于需要存储远期时间的场景,建议使用DATETIME。

【问题】 列设置为 AUTO INCREMENT 时,如果在表中达到最大值,会发生什么情况?

【参考答案】 当自增列达到该数据类型所允许的最大值时,AUTO_INCREMENT 将无法继续递增。

- 后果:随后的插入操作将会失败,MySQL 会报错(通常是

Duplicate entry 'xxx' for key 'PRIMARY'),因为尝试插入的值已经存在。 - 解决方式:需要根据业务需求更改字段类型(例如从

INT改为BIGINT),或者清理旧数据并重置计数器。

【延伸考点讲解】

- 数据类型限制:

TINYINT UNSIGNED:最大 255INT UNSIGNED:最大 4,294,967,295(约 42 亿)BIGINT UNSIGNED:最大 $2^{64}-1$(几乎不可能达到溢出)

- 监控报警:在生产环境中,建议对核心表的自增主键使用率进行监控,当使用率达到 80% 时即触发报警。

- 主键设计:对于预期数据量巨大的表,建议在设计之初就直接使用

BIGINT作为主键,以规避未来可能出现的溢出风险和高昂的改表成本。

【问题】 怎样才能找出最后一次插入时分配了哪个自动增量?

【参考答案】 可以使用 MySQL 内置函数 LAST_INSERT_ID() 来获取最后一次插入操作生成的自增 ID。

- 基本用法:执行

SELECT LAST_INSERT_ID();即可返回最近一条INSERT语句产生的AUTO_INCREMENT值。 - 特点:该函数是 基于会话(Session) 的。这意味着它返回的是当前连接中最后一次产生的 ID,而不会受到其他并发连接插入操作的影响,因此是线程安全的。

【延伸考点讲解】

- 多行插入:如果在一条

INSERT语句中插入了多行数据,LAST_INSERT_ID()只会返回 第一行 产生的 ID。 - 应用场景:常用于父子表关联插入。先插入父表,获取产生的 ID,再将该 ID 作为外键插入子表。

- 与 MAX(id) 的区别:千万不要使用

SELECT MAX(id) FROM table来获取最新 ID。在高并发环境下,MAX(id)可能会获取到其他事务刚刚插入的 ID,导致逻辑错误。

【问题】 BLOB 和 TEXT 有什么区别?

【参考答案】 BLOB(Binary Large Object)和 TEXT 都是用于存储大量数据的类型,它们的主要区别在于对字符集和排序规则的处理:

- 数据性质:

- BLOB:存储二进制数据(如图片、视频、音频、可执行文件等)。它没有字符集的概念。

- TEXT:存储大文本数据(如文章内容、评论等)。它关联有字符集(如 utf8mb4)。

- 大小写敏感性:

- BLOB:在排序和比较时是 区分大小写 的(因为它被视为字节字符串)。

- TEXT:在排序和比较时通常是 不区分大小写 的(取决于所选字符集的 Collation)。

- 大小限制:两者都有四个变体(TINY, REGULAR, MEDIUM, LONG),最大存储容量相同(LONG 类型可达 4GB)。

【延伸考点讲解】

- 性能影响:由于

BLOB和TEXT数据通常非常大,MySQL 会将其存储在行之外(Off-page Storage)。在查询时,如果不需要这些字段,务必避免使用SELECT *,否则会产生大量的 I/O 开销。 - 索引限制:不能直接对完整的

BLOB或TEXT列建立索引,必须指定索引前缀长度(Prefix Indexing)。 - 临时表风险:包含

BLOB或TEXT的查询在排序时可能无法使用内存临时表,而被迫使用磁盘临时表,这会严重降低查询效率。

【问题】 MySQL 当记录不存在时 insert,当记录存在时 update,语句怎么写?

【参考答案】 在 MySQL 中,通常有两种主流方式来实现这种“存在即更新,不存在即插入”(Upsert)的逻辑:

- ON DUPLICATE KEY UPDATE(推荐):

- 语法:

INSERT INTO table (a, b, c) VALUES (1, 2, 3) ON DUPLICATE KEY UPDATE c = c + 1; - 原理:如果插入导致唯一索引(UNIQUE)或主键(PRIMARY KEY)冲突,则执行后面的

UPDATE逻辑。

- 语法:

- REPLACE INTO:

- 语法:

REPLACE INTO table (a, b, c) VALUES (1, 2, 3); - 原理:如果发现冲突,MySQL 会先 删除 旧记录,然后再 插入 新记录。

- 语法:

【延伸考点讲解】

- 两者的区别:

ON DUPLICATE KEY UPDATE是原地更新,保留原有记录的其他字段和自增 ID。REPLACE INTO是“删后插”,会导致自增 ID 发生变化,且如果表中存在外键约束或触发器,可能会引发非预期的问题。

- 性能对比:在高并发场景下,

ON DUPLICATE KEY UPDATE的性能通常优于REPLACE INTO,因为后者涉及两次操作(DELETE + INSERT)。 - INSERT IGNORE:如果只想在不存在时插入,存在时直接忽略(不报错也不更新),可以使用

INSERT IGNORE INTO ...。

【问题】 MySQL 中的数据排序是怎么实现的?

【参考答案】 MySQL 中的排序主要通过两种方式实现:内部排序(Using filesort) 和 索引排序。

- 索引排序:如果

ORDER BY的字段已经建立了索引,MySQL 可以直接利用 B+ 树索引的有序性返回结果,无需额外排序。EXPLAIN的Extra列不会出现Using filesort。 - 内部排序(Filesort):当无法利用索引排序时,MySQL 会在内存中执行排序操作。具体分为两种算法:

- 双路排序(传统排序):第一次读取行指针和 ORDER BY 列,排序后再回表读取完整数据。产生两次 I/O。

- 单路排序(Modified Algorithm):一次性读取查询所需的所有列到排序缓冲区,排序后直接返回。减少了 I/O 但占用更多内存。 排序缓冲区大小由

sort_buffer_size控制。如果排序数据量超过该值,MySQL 会使用磁盘临时文件进行外部归并排序,性能急剧下降。

【大白话解释】 排序就像整理图书馆的书籍。如果书本来就按编号排好(索引有序),直接取就行。如果书是乱放的,你需要把书搬到一张大桌子上(sort_buffer),按规则排好后再放回。桌子够大就一次搞定,桌子不够大就只能分批搬,中间还要把部分结果暂存到别处(磁盘临时文件),效率自然就低了。

【扩展知识点详解】

- 优化建议:尽量让

ORDER BY走索引;避免SELECT *以减少单路排序的内存消耗;适当增大sort_buffer_size。 - 降序索引:MySQL 8.0 之前不支持同一查询中混合 ASC/DESC 使用索引排序,8.0 引入了降序索引解决此问题。

- 监控:通过

Sort_merge_passes状态变量监控磁盘排序次数,若大于 0 说明需要优化。

【问题】 详细描述一条 SQL 语句在 MySQL 中的执行过程。

【参考答案】 一条 SQL 语句在 MySQL 中的执行过程涉及 Server 层和存储引擎层的协作:

- 连接器:客户端与 MySQL 建立连接,验证用户身份和权限。

- 查询缓存(MySQL 8.0 已移除):以 SQL 语句为 key 查找缓存,命中则直接返回。

- 解析器:对 SQL 进行词法分析和语法分析,生成抽象语法树(AST)。

- 预处理器:检查表和列是否存在、解析别名和通配符,并进行权限验证。

- 优化器:基于成本估算选择最优执行计划,包括选择索引、决定连接顺序等。

- 执行器:根据执行计划调用存储引擎接口,逐行获取数据并返回结果。

- 存储引擎层:负责数据的实际存取。InnoDB 通过 B+ 树索引定位数据页,从缓冲池或磁盘读取数据。

【大白话解释】 就像去餐厅点菜:连接器是迎宾(检查你是不是会员);查询缓存是服务员想“这桌刚才是不是点过一样的菜”(8.0后不再提供);解析器确认菜名有没有这道菜;优化器是厨师决定先做哪个菜更快;执行器把单子传给厨房;存储引擎就是厨房,真正开始炒菜。

【扩展知识点详解】

- 连接管理:长连接复用 TCP 连接,但可能累积内存占用;短连接每次新建 TCP。

- 优化器成本模型:基于 CPU 成本和 I/O 成本计算,可通过

EXPLAIN FORMAT=JSON查看。 - 执行器与引擎交互:执行器通过 handler API(如

index_first()、rnd_next())获取数据。

【问题】 MySQL 中 count(*)、count(1) 和 count(字段名) 有什么区别?

【参考答案】

- count(*):统计总行数,包括 NULL 值。InnoDB 会遍历最小的二级索引(比聚簇索引更小)来计数,性能最优。

- count(1):与

count(*)完全等价,没有任何性能差异。MySQL 优化器会将count(1)转换为count(*)。 - count(字段名):统计该字段非 NULL 的行数。如果字段不允许 NULL,则结果与

count(*)相同。InnoDB 需要遍历索引并逐行判断字段是否为 NULL,性能略差。 - count(DISTINCT 字段名):统计该字段不同值的数量(忽略 NULL)。

【大白话解释】 count(*) 和 count(1) 都是在数人,不管这个人有没有填某项信息。count(字段名) 是数填了某项信息的人,没填的不算。所以 count(*) 最快,因为不需要检查每个字段。

【扩展知识点详解】

- 为什么 InnoDB 不像 MyISAM 那样快速 count:MyISAM 存储了精确行数(因为只有表锁),InnoDB 由于 MVCC,不同事务可能看到不同行数,无法缓存。

- 优化建议:用 Redis 维护计数器;使用估计值

SHOW TABLE STATUS;使用汇总表。

【问题】 如何在 MySQL 中监控和优化慢 SQL?

【参考答案】 监控和优化慢 SQL 的完整流程:

- 开启慢查询日志:

slow_query_log = ONlong_query_time = 1(超过 1 秒记录)slow_query_log_file指定日志路径

- 分析慢日志:使用

mysqldumpslow工具按查询时间或出现次数排序,快速定位最慢的 SQL。 - EXPLAIN 分析:对慢 SQL 执行

EXPLAIN,重点关注type(是否全表扫描)、key(是否命中索引)、rows(扫描行数)、Extra(是否 filesort/temporary)。 - 优化手段:

- 添加或调整索引(覆盖索引、联合索引)。

- 避免

SELECT *、减少回表。 - 拆分复杂查询为简单查询。

- 使用

FORCE INDEX临时验证索引效果(不推荐生产使用)。

- 性能监控工具:

Performance Schema、sys库、pt-query-digest。

【大白话解释】 监控慢 SQL 就像体检:先拍X光(开启慢日志)看哪里有问题;再用放大镜看(EXPLAIN)具体什么指标异常;然后对症下药(加索引、改SQL)。

【扩展知识点详解】

- pt-query-digest:Percona 提供的工具,比

mysqldumpslow功能更强,支持生成详细报告。 - Performance Schema:MySQL 内置的性能监控,可追踪文件 I/O、锁等待、内存使用等。

- 慢日志的副作用:开启慢日志有微小性能开销(约 1%-2%),建议生产环境始终开启。

【问题】 MySQL 的查询优化器如何选择执行计划?

【参考答案】 MySQL 优化器通过 基于成本的估算 来选择执行计划:

- 成本模型:总成本 = I/O 成本(读取数据页的次数) + CPU 成本(比较和过滤的行数)。

- 统计信息:InnoDB 通过随机采样 8 个数据页估算表的基数(cardinality)和行数。统计信息存储在

mysql.innodb_table_stats和innodb_index_stats中。 - 索引选择:优化器估算使用每个索引的成本,选择成本最低的方案。

- 连接顺序:多表连接时,优化器尝试不同连接顺序,选择成本最低的(小表驱动大表)。

- 子查询优化:优化器可能将子查询改写为半连接(Semi-Join)或物化表。

【大白话解释】 优化器就像导航软件:它知道各条路的距离(统计信息),估算每条路的拥堵程度(I/O 成本),然后给你推荐最快的路线。但它估算可能不准(统计信息过时),这时可以手动指定路线(FORCE INDEX)。

【扩展知识点详解】

- 统计信息不准确:数据大量变更后需执行

ANALYZE TABLE更新统计信息。 - 索引选择错误:可通过

EXPLAIN对比possible_keys和key判断。必要时使用FORCE INDEX。 - 查看成本:

EXPLAIN FORMAT=JSON中的cost_info字段可查看具体成本值。

【问题】 为什么在 MySQL 中不推荐使用多表 JOIN?

【参考答案】 不推荐多表 JOIN 的核心原因:

- 性能问题:多表 JOIN 会导致执行计划复杂化,优化器难以选择最优方案。嵌套循环连接下,被驱动表可能被多次扫描。

- 锁范围扩大:JOIN 操作可能同时锁定多张表的行,增加锁冲突概率。

- 可维护性差:复杂 JOIN 的 SQL 可读性差,调试和优化困难。

- 扩展性差:分库分表后,跨库 JOIN 几乎不可能。应用层 JOIN 更容易拆分为微服务。

- 笛卡尔积风险:缺少连接条件时会产生笛卡尔积,导致性能灾难。

【大白话解释】 多表 JOIN 就像让一个人同时处理多个部门的工作,很容易顾此失彼。更好的做法是每个部门单独处理,最后在领导(应用层)那里汇总。这样即使某个部门出了问题也不会影响其他部门。

【扩展知识点详解】

- 替代方案:在应用层分别查询再组装;使用冗余字段避免 JOIN;使用数据仓库处理复杂分析。

- 阿里巴巴规范:Java 开发手册明确规定超过三张表禁止 JOIN。

- 适当场景:2-3 张表的简单 JOIN,且有合适索引时,性能通常可以接受。

【问题】 MySQL 中 EXISTS 和 IN 的区别是什么?

【参考答案】

- 语法差异:

EXISTS返回 true/false,判断子查询是否返回行;IN判断某个值是否在子查询结果集中。 - 执行逻辑差异:

- EXISTS:先遍历外表,对外表每行执行子查询,一旦找到匹配就停止。适合外表小、内表大的场景。

- IN:先执行子查询得到结果集,再与外表匹配。适合内表小、外表大的场景。

- NULL 处理:

IN中如果有 NULL,NOT IN可能返回空结果(NULL NOT IN结果为 NULL);NOT EXISTS不受 NULL 影响。 - 索引利用:

EXISTS对内表使用索引;IN对外表使用索引。

【大白话解释】 EXISTS 像“去图书馆找有没有这本书”,找到一本就停;IN 像“先列出所有书的清单,再逐个核对”。如果图书馆书很多但你要查的类型少,用 IN;如果图书馆书不多但每种类型很多,用 EXISTS。

【扩展知识点详解】

- 小表驱动大表:子查询结果集小用

IN,外表小用EXISTS。MySQL 优化器通常会自动将IN改写为半连接。 - NOT IN 的 NULL 陷阱:

SELECT * FROM t1 WHERE id NOT IN (SELECT id FROM t2 WHERE id IS NOT NULL)需排除 NULL。 - MySQL 6.0+ 优化:优化器会将

IN子查询自动改写为EXISTS或 Semi-Join,两者性能差异趋近。

【问题】 MySQL 中 LIMIT 100000000, 10 和 LIMIT 10 的执行速度是否相同?

【参考答案】 不相同,LIMIT 100000000, 10 远慢于 LIMIT 10:

- 执行差异:

LIMIT 100000000, 10需要 MySQL 先扫描并跳过前 1 亿行,再返回 10 行。即使有索引,也需要遍历大量数据。 - LIMIT 10:引擎找到前 10 条匹配记录就立即返回,几乎不需要扫描。

- 深分页问题:

LIMIT offset, n的 offset 越大,性能越差,因为需要读取 offset+n 行再丢弃前 offset 行。

【大白话解释】 就像在一本 1 亿页的书中,LIMIT 10 是翻前 10 页就停;LIMIT 100000000, 10 是翻过 1 亿页后再看 10 页,这 1 亿页都得翻过去。

【扩展知识点详解】

- 优化方案:基于游标的分页(

WHERE id > last_id LIMIT 10)、子查询延迟关联、覆盖索引。 - 业务层面:限制最大翻页深度,采用“下一页”模式(类似微博/抖音的无限滚动)。

锁机制

【问题】 MySQL 中有哪几种锁?

【参考答案】 MySQL 的锁机制主要可以从两个维度进行划分:存储引擎支持程度和锁定粒度。

- 按粒度划分:

- 表级锁 (Table Lock):锁定整张表。开销小,加锁快,不会出现死锁;但锁定粒度大,冲突概率最高,并发度最低(MyISAM 默认)。

- 行级锁 (Row Lock):锁定特定的数据行。开销大,加锁慢,会出现死锁;但锁定粒度最小,冲突概率低,并发度最高(InnoDB 默认)。

- 页级锁 (Page Lock):锁定数据页,粒度介于表锁和行锁之间(BDB 引擎支持)。

- 按类型划分(行锁/表锁内):

- 共享锁 (S 锁):允许事务读取一行数据,阻止其他事务获得相同数据集的排他锁。

- 排他锁 (X 锁):允许事务删除或更新数据,阻止其他事务获得相同数据集的共享锁和排他锁。

- 意向锁 (IS/IX):表级锁,用于表示事务准备在行级别加锁。

【生动例子与内部逻辑】 为了理解这些锁的配合,我们可以使用 “图书馆办公楼” 的例子:

- 场景:假设图书馆有一栋办公楼(数据库),楼里有很多层(数据页),每层有很多房间(数据行)。

- 行锁与排他锁:某位老师想在 201 房间(行)闭关写书,他进去后反锁了门(加排他锁 X)。此时其他老师既不能进去看书,也不能进去写书。

- 意向锁 (IS/IX):这位老师在反锁 201 房间的同时,必须在二楼的电梯口立一个牌子:“本层有房间正在使用”(加意向排他锁 IX)。

- 表锁的冲突检查:此时,楼层管理员(系统事务)想要关闭整层楼进行电路检修(申请表级排他锁 X)。如果没有电梯口的牌子(意向锁),管理员必须推开二楼每一个房间的门去检查是否有人;有了牌子,管理员一眼就能看到本层有房间被锁定,从而直接等待,效率大幅提升。

【延伸考点讲解】

- 意向锁的逻辑核心:意向锁(IS/IX)是表级锁,它们存在的唯一目的就是为了在之后加表锁时能够快速判断表中的记录是否被行锁锁定,从而避免全表扫描。

- 锁的兼容性:

- 意向锁之间是互相兼容的(多个事务可以同时在不同行加锁)。

- 意向锁与表级 S/X 锁可能冲突(如 IX 锁与表级 S 锁冲突)。

- 行锁的实现原理:InnoDB 的行锁是通过给 索引上的索引项 加锁来实现的,而不是给真实的记录加锁。这意味着如果查询没有走索引,InnoDB 将会使用表锁(通过隐藏的聚集索引锁定所有行)。

- 死锁检测:InnoDB 会自动监测死锁,并通过回滚持有最少行级排他锁的事务来解除死锁。

【问题】 数据库怎样保证并发更新不出错?

【参考答案】 并发更新的核心挑战在于 “丢失更新(Lost Update)” 问题。解决该问题的常用方案包括:

- 悲观锁 (Pessimistic Locking):

- 逻辑:假设冲突一定会发生。在更新前先对行加锁(如

FOR UPDATE),直到事务提交。 - 效果:其他尝试更新该行的事务会被阻塞,直到当前事务释放锁。

- 逻辑:假设冲突一定会发生。在更新前先对行加锁(如

- 乐观锁 (Optimistic Locking):

- 逻辑:假设冲突很少发生。不使用数据库锁,而是在更新时检查数据版本(通常通过

version字段)。 - 实现:

UPDATE table SET balance = new_val, version = version + 1 WHERE id = ? AND version = {读取时的版本号}。

- 逻辑:假设冲突很少发生。不使用数据库锁,而是在更新时检查数据版本(通常通过

【生动例子与运行逻辑】 假设账户余额为 100,用户 A 和 B 同时发起扣款操作:

- 悲观锁模式:

- A 开启事务并执行

SELECT balance FROM account WHERE id=1 FOR UPDATE,锁定了该行。 - B 此时尝试执行同样的语句,会被数据库挂起等待。

- A 扣除 50 余额变为 50,提交事务。

- B 被唤醒,读取到最新的余额 50,再扣除 30 变为 20,提交事务。最终余额 20,数据正确。

- A 开启事务并执行

- 乐观锁模式:

- A 和 B 同时读取到余额 100 和版本号 1。

- A 先执行更新,

WHERE version = 1匹配成功,余额变 50,版本号变 2。 - B 尝试执行更新,

WHERE version = 1匹配失败(此时已是 2),受影响行数为 0。 - B 需要根据业务逻辑进行重试(重新读取最新余额 50,版本 2,再尝试更新)。

【延伸考点讲解】

- 适用场景:

- 悲观锁:适用于写操作极度频繁、冲突概率高的场景,避免了大量乐观锁重试带来的性能开销。

- 乐观锁:适用于读多写少、冲突概率低的场景,因不加锁而具有更高的吞吐量。

- CAS 的 ABA 问题:在乐观锁中,如果版本号仅基于业务值,可能出现值先变 A 再变 B 再变回 A 的情况。引入单调递增的

version字段可完美规避此问题。 - 死锁风险:悲观锁在高并发多表操作下可能导致死锁;乐观锁本质上是无锁方案,不存在死锁风险。

【问题】 对比一下悲观锁和乐观锁?

【参考答案】 悲观锁和乐观锁是并发控制中两种截然不同的策略,它们并非真实的数据库锁,而是设计思想:

- 悲观锁 (Pessimistic Locking):

- 核心思想:假定数据每次读取都会被他人修改。

- 实现方式:依靠数据库提供的锁机制(如

FOR UPDATE)。 - 适用场景:写操作密集、冲突频繁、追求数据绝对安全的场景。

- 乐观锁 (Optimistic Locking):

- 核心思想:假定数据在读取到更新期间通常不会被修改。

- 实现方式:在应用层通过版本号(Version)或 CAS 机制实现。

- 适用场景:读多写少、并发量大、对响应时间要求高的场景。

【生动例子与内部逻辑】 我们可以用 “图书馆借书” 的场景来类比:

- 悲观锁模式(老式闭架借阅): 读者想看某本书,必须先去前台申请,管理员将书从书架取出并登记该书“已被借走”。此时其他任何人都无法看到或借阅这本书,直到该读者归还。

- 逻辑:加锁 -> 操作 -> 释放锁。这种方式虽然安全,但如果读者看书太慢,书架的利用率就很低。

- 乐观锁模式(现代开架借阅): 书架上的书谁都可以拿去翻看。每个读者的借书证上记录了该书的版本(如第 3 版)。当读者去前台办理借阅时,管理员会检查:该书在书架上的版本是否依然是第 3 版?

- 逻辑:如果是,说明期间没人修改过,借阅成功,版本更新为 4。如果书架上已经是第 4 版了(说明被别人先借走并还回来了),管理员会告知你借阅失败,请重新拿新版。

【延伸考点讲解】

- 性能权衡:

- 悲观锁:由于需要排队,会产生大量的锁等待和上下文切换开销。

- 乐观锁:省去了锁的申请和释放过程,但在高冲突环境下,频繁的重试(自旋)会消耗大量 CPU 资源。

- 死锁风险:悲观锁可能导致事务互相等待产生死锁;乐观锁由于不加锁,不存在死锁。

- ABA 问题:在乐观锁中,如果版本号定义不当,可能出现数据被修改后又改回原值的情况。引入单调递增的数字

version是解决 ABA 问题的标准做法。

【问题】 MySQL 中如果发生死锁应该如何解决?

【参考答案】 MySQL 死锁的解决分为 自动处理 和 手动预防 两个层面:

- InnoDB 自动检测:InnoDB 自动检测死锁,通过回滚持有最少行级排他锁的事务来解除死锁。可通过

SHOW ENGINE INNODB STATUS查看最近一次死锁信息。 - 手动排查:

- 开启

innodb_print_all_deadlocks将死锁信息记录到错误日志。 - 分析死锁日志中的事务持有锁和等待锁的对应关系。

- 开启

- 预防措施:

- 按固定顺序访问表和行(如按主键升序)。

- 大事务拆分为小事务,减少锁持有时间。

- 合理使用索引,避免行锁升级为表锁。

- 设置

innodb_lock_wait_timeout(默认 50 秒),超时自动回滚。 - 低隔离级别(RC)不使用间隙锁,减少死锁概率。

【大白话解释】 死锁就像两个人面对面走过窄桥,都在等对方让路。MySQL 会自动识别谁占的资源少就让谁退回去(回滚)。预防死锁的最好办法是让所有人靠右走(固定顺序访问),这样就不会撞上了。

【扩展知识点详解】

- 死锁日志分析:关注 LATEST DETECTED DEADLOCK 中的

*** (1) HOLDS THE LOCK和*** (2) HOLDS THE LOCK部分。 - Gap Lock 死锁:RR 级别下间隙锁是死锁高发区,可考虑使用 RC 避免间隙锁。

- 乐观锁替代:对冲突率低的场景,使用乐观锁(版本号)代替悲观锁,从根本上避免死锁。

事务

【问题】 什么是 MySQL 的 redo log 和 binlog?

【参考答案】 MySQL 包含两类核心日志,分别由 Server 层和存储引擎层维护:

- binlog(归档日志):

- 所属层:Server 层,所有引擎通用。

- 性质:逻辑日志,记录 SQL 语句的原始逻辑(如“给 ID=2 的行 c 字段加 1”)。

- 写入方式:追加写,不会覆盖旧日志。

- 作用:主从复制、数据恢复。

- redo log(重做日志):

- 所属层:InnoDB 引擎层特有。

- 性质:物理日志,记录物理页的变更(如“在某个数据页的某个偏移量处做了什么修改”)。

- 写入方式:循环写,空间固定,写满后会覆盖开头。

- 作用:崩溃恢复(Crash-safe),保证事务的持久性。

【生动例子与内部逻辑】 我们可以用 “掌柜记账” 的例子来理解:

- 场景:古代酒店掌柜有一个账本(磁盘数据文件),还有一个粉板(redo log)。

- redo log 的逻辑(WAL 机制):当客人来赊账时,如果直接翻开厚重的账本查找到该客人再修改,效率极低(随机 I/O)。掌柜会先在粉板上记下这笔账(顺序 I/O),等打烊后再同步到账本。即使酒店突然停电(数据库宕机),掌柜只要看一眼粉板,就能恢复账本中还没记上的账。这就是 WAL (Write-Ahead Logging)。

- binlog 的逻辑:binlog 就像是酒店的流水单据。即使粉板擦了、账本丢了,只要流水单据还在,就能从头开始算出现在的账目(数据恢复)。

- 两阶段提交 (2PC):为了保证“粉板”和“流水单”一致,掌柜在记账时分为两步:

- 先在粉板记下账目,标记为“准备好了”(Prepare)。

- 写流水单据(binlog 写入)。

- 在粉板上把状态改为“已完成”(Commit)。

【深度技术解析】

- redo log 的循环结构:

- redo log 由固定大小的文件组成(如 4 个 1GB 文件)。

- write pos 是当前记录的位置,一边写一边后移。

- checkpoint 是当前要擦除的位置(即已同步到磁盘的位置)。

- 如果

write pos追上了checkpoint,说明 redo log 已满,MySQL 会停止所有更新操作,先推动checkpoint刷盘。

- binlog 的三种格式:

- STATEMENT:记录原始 SQL。优点是日志量小,缺点是在使用

UUID()、NOW()等函数时可能导致主从数据不一致。 - ROW(推荐):记录行的实际变更。优点是数据绝对安全,缺点是日志量巨大(如一条

UPDATE影响万行,会记录万条变更)。 - MIXED:混合模式。普通 SQL 用 STATEMENT,可能导致不一致的 SQL 自动转为 ROW。

- STATEMENT:记录原始 SQL。优点是日志量小,缺点是在使用

- 2PC 崩溃恢复细节:

- 如果在 Prepare 之后、Commit 之前发生宕机:

- 扫描 redo log。如果发现事务处于

Prepare状态,则去查看 binlog 中是否存在对应的XID。 - binlog 存在且完整:提交事务。因为 binlog 已写入,不提交会导致主从不一致。

- binlog 不存在:回滚事务。因为该事务尚未真正完成。

- 扫描 redo log。如果发现事务处于

- 如果在 Prepare 之后、Commit 之前发生宕机:

【高阶面试深度补充】

- 组提交 (Group Commit):

- 问题:每次事务提交都要刷盘(fsync),会导致磁盘 I/O 成为瓶颈。

- 优化:MySQL 会将多个并发事务的日志写入操作合并为一次 fsync,从而极大提高 TPS。

- 双写缓冲 (Doublewrite Buffer):

- 问题:如果数据库宕机时,InnoDB 正在写一个 16KB 的数据页,只写了 4KB 停电了(页断裂/Partial Page Write),此时 redo log 无法修复(因为它记录的是物理修改而非完整页)。

- 解决:在写数据页之前,先将页副本顺序写入系统表空间的双写缓冲区。宕机恢复时,如果数据页损坏,先从双写缓冲区还原页,再应用 redo log。

- Change Buffer 与 redo log 的关系:

- 当更新非聚集索引且数据页不在内存时,InnoDB 会将修改记录在

Change Buffer中,并同步记入redo log。 - 这样即使不随机读磁盘(将数据页读入内存),也能保证修改的持久化。

- 当更新非聚集索引且数据页不在内存时,InnoDB 会将修改记录在

- 日志刷盘的具体性能损耗:

- 磁盘 I/O 是数据库最慢的部分。

sync_binlog=1和innodb_flush_log_at_trx_commit=1的组合被称为 “双 1 配置”,是保证数据绝对不丢失的最高安全级别,但会对性能产生 20%~50% 的损耗。

- 磁盘 I/O 是数据库最慢的部分。

【延伸考点讲解】

- sync_binlog 参数:控制 binlog 刷盘频率。设置为 1 表示每次事务提交都刷盘,最安全。

- innodb_flush_log_at_trx_commit 参数:控制 redo log 刷盘策略。设置为 1 表示每次提交都持久化到磁盘。

- 为什么不能只用 binlog 恢复?:binlog 是逻辑日志,它不具备“脏页检查”的能力。当数据库宕机时,binlog 无法知道哪些数据已经写入磁盘,哪些还在内存。而 redo log 记录了物理修改,且通过

checkpoint明确知道哪些修改还没落盘,因此只有 redo log 能实现 Crash-safe。

【问题】 MySQL 怎么保证原子性的?怎么保证事务的 ACID?

【参考答案】 InnoDB 引擎通过日志(redo/undo log)、锁机制以及 MVCC 共同保证了事务的 ACID 特性:

- 原子性 (Atomicity):由 undo log 保证。记录了每步操作的反向操作(如插入对应删除),当事务失败时利用 undo log 将数据回滚到初始状态。

- 一致性 (Consistency):是事务追求的终极目标。通过原子性、持久性和隔离性共同保障,确保数据库从一个合法的状态转变到另一个合法的状态。

- 隔离性 (Isolation):由 锁机制 和 MVCC(多版本并发控制)保证。确保并发执行的事务之间互不干扰。

- 持久性 (Durability):由 redo log 保证。修改操作先写入 redo log 并刷盘,即使数据库宕机,重启后也能根据 redo log 恢复未落盘的数据。

【生动例子与内部逻辑】 以 “银行转账” 为例(A 转账 100 元给 B):

- 原子性保证:如果在 A 扣钱成功、B 加钱失败时发生错误,MySQL 会查找 undo log。undo log 中记录了“给 A 账号加回 100 元”的操作,系统自动执行回滚,保证转账要么全成功,要么全失败。

- 持久性保证:A 扣钱的操作一旦提交,系统会立即将该变更记录在 redo log 并强制刷盘。就算此时银行机房突然停电,由于 redo log 已经在磁盘上,电力恢复后系统能自动根据日志把 A 扣钱的变更同步到账本文件中。

- 隔离性保证:在 A 转账期间,如果 C 想查询 A 的余额,MVCC 会让 C 看到转账前的“快照”版本,而不是转账中途的中间状态。

【延伸考点讲解】

- Force Log at Commit:为了保证持久性,InnoDB 要求在事务提交前,其产生的 redo log 必须已经落盘(fsync),这被称为“提交时强制日志刷新”。

- undo log 的清理:undo log 不会立即删除,它不仅用于回滚,还用于 MVCC 读快照。只有当系统中没有事务再需要该版本数据时,后台的

Purge线程才会将其清理。 - 一致性的双重含义:一致性不仅指数据库内部的物理一致性(如 B+ 树结构完整),更指业务逻辑上的一致性(如转账前后总金额不变)。

【问题】 什么是 undo log 和 MVCC?

【参考答案】 undo log(回滚日志)和 MVCC(多版本并发控制)是 InnoDB 引擎实现事务隔离级别(尤其是 RC 和 RR)的核心底层技术:

- undo log:物理上是存储在回滚段中的一系列日志,逻辑上记录了数据行的所有历史快照。每当数据发生修改,旧版本就会存入 undo log 并通过隐藏的

DATA_ROLL_PTR指针串联成一个 版本链。 - MVCC:一种非锁定读的实现方案。它通过读取版本链中符合可见性规则的版本,使读操作不被写操作阻塞。

- ReadView:决定“当前事务能看到版本链中的哪个版本”。它包含四个核心属性:

m_ids:生成 ReadView 时,当前系统中活跃且未提交的事务 ID 列表。min_trx_id:m_ids中的最小值。max_trx_id:系统即将分配给下一个事务的 ID(即当前最大事务 ID + 1)。creator_trx_id:创建该 ReadView 的事务 ID。

【生动例子与内部逻辑】 想象一个 “公文修改” 的场景:

- 版本链:公文(数据行)正在被修改。每次修改前,旧版都会存入存档柜(undo log),新公文注明“上个版本在柜子几号”。

- MVCC 判定规则:

- 规则 1:如果被访版本的

trx_id<min_trx_id:说明该版本在 ReadView 生成前已提交,可见。 - 规则 2:如果

trx_id>=max_trx_id:说明该版本在 ReadView 生成后才开启,属于未来的版本,不可见。 - 规则 3:如果

min_trx_id<=trx_id<max_trx_id:- 若

trx_id在m_ids列表中:说明该版本所属事务仍活跃,不可见。 - 若

trx_id不在m_ids列表中:说明事务已提交,可见。

- 若

- 规则 1:如果被访版本的

- 隔离级别的差异:

- RC(读已提交):事务中每次 SELECT 都会生成一个全新的 ReadView,因此能读到其他事务中途提交的数据。

- RR(可重复读):事务中仅在第一次 SELECT 时生成一个 ReadView,后续查询共用此视图,从而保证了可重复读。

【延伸考点讲解】

- 隐藏字段:每行记录包含

DATA_TRX_ID(最后修改事务 ID)和DATA_ROLL_PTR(指向 undo log)。 - 快照读 vs 当前读:

- 普通

SELECT是 快照读,不加锁,依靠 MVCC。 SELECT ... FOR UPDATE、UPDATE、DELETE等是 当前读,必须读取最新版本并加锁(行锁、间隙锁)。

- 普通

- undo log 的分类:

- insert undo log:仅用于事务回滚,事务提交后即可删除。

- update undo log:用于回滚和 MVCC,需等到没有 ReadView 再引用时,由 Purge 线程清理。

【问题】 MySQL 中长事务可能会导致哪些问题?

【参考答案】 长事务(执行时间很长的事务)会带来多方面的问题:

- 锁持有时间过长:长事务持有行锁、间隙锁的时间长,阻塞其他事务的写操作,导致并发性能严重下降甚至死锁。

- undo log 膨胀:长事务阻止 undo log 的清理(Purge 线程无法回收),导致回滚段空间持续增长。

- 主从延迟:大事务在 binlog 中产生大量事件,从库需要很长时间重放,导致同步延迟加剧。

- 连接资源占用:长事务占用数据库连接,高并发时可能导致连接池耗尽。

- 数据回滚风险:如果长事务最终回滚,所有中间操作白费,且回滚本身也很耗时。

【大白话解释】 长事务就像一个人在超市霸占收银台半天不走:后面排队的人全被堵住(锁等待);他买的商品占满了寄存柜(undo log 膨胀);如果他最后说“我不要了”,超市还得一件件把商品放回去(回滚),浪费大量时间。

【扩展知识点详解】

- 监控长事务:

SELECT * FROM information_schema.INNODB_TRX WHERE TIME_TO_SEC(TIMEDIFF(NOW(), trx_started)) > 60; - 参数控制:

wait_timeout控制非交互连接超时;Percona 版本可自动杀空闲长事务。 - 最佳实践:事务中避免 RPC 调用和复杂计算;拆分大事务为小事务;设置事务超时。

【问题】 MySQL 二级索引有 MVCC 快照吗?

【参考答案】 二级索引本身没有完整的 MVCC 快照。InnoDB 的 MVCC 主要依赖聚簇索引中的隐藏字段(DATA_TRX_ID 和 DATA_ROLL_PTR)以及 undo log 版本链。二级索引的叶子节点只存储索引列值和主键值,不包含事务 ID 和回滚指针。

通过二级索引读取数据时,判断可见性的流程:

- 从二级索引找到匹配的主键值。

- 回表到聚簇索引,通过版本链和 ReadView 判断可见性。

- 若不可见,沿 undo log 版本链查找历史版本。

MySQL 5.7+ 优化:二级索引页的 MAX_TRX_ID 可快速判断该页是否在 ReadView 后被修改。若 MAX_TRX_ID < min_trx_id,则该页所有记录可见,无需回表。

【大白话解释】 二级索引像图书馆的书名目录卡,只写了书名和编号,没写“谁最后改了这本书”。要知道是不是你能看到的版本,还得拿着编号去找书架上的原书(回表)。不过如果目录卡所在的区域标注了“本区最近无人修改”(MAX_TRX_ID 较旧),你就不用一本本查了。

【扩展知识点详解】

- 性能影响:二级索引的 MVCC 判断需要回表,这是 RR 级别下比聚簇索引慢的一个原因。

- Delete Mark:InnoDB 删除记录时先标记为“删除”而非立即物理删除,保证二级索引仍有记录可用于 MVCC 判断。

【问题】 如果 MySQL 中没有 MVCC,会有什么影响?

【参考答案】 如果没有 MVCC,数据库的并发性能将大幅下降:

- 读阻塞写:读操作必须加共享锁,写操作必须等待读锁释放。读多写少场景下,写操作几乎无法执行。

- 写阻塞读:写操作持有排他锁期间,所有读操作都必须等待。

- 并发吞吐量骤降:读写互相阻塞,系统整体 TPS/QPS 急剧下降。

- 锁竞争加剧:大量事务等待锁释放,超时和死锁概率显著上升。

有了 MVCC 后,普通 SELECT(快照读)不加锁,读写互不阻塞,极大提升并发性能。

【大白话解释】 没有 MVCC 就像在图书馆里,只要有人在看书(读锁),其他人就不能往书架上放书(写锁);有人在放书,其他人就不能看书。有了 MVCC,每个人看的是书的历史副本(快照),放书的人往书架上放新版本,互不干扰。

【扩展知识点详解】

- 快照读与当前读:MVCC 只优化快照读。当前读(

FOR UPDATE、UPDATE、DELETE)仍需加锁。 - 其他数据库:PostgreSQL 和 Oracle 也使用 MVCC;SQL Server 默认基于锁,但可开启 RCSI。

【问题】 你们生产环境的 MySQL 中使用了什么事务隔离级别?为什么?

【参考答案】 大多数互联网生产环境使用 REPEATABLE READ(可重复读),这也是 InnoDB 默认隔离级别。原因:

- MySQL 默认:无需额外配置。

- 防止幻读:InnoDB 在 RR 下通过 MVCC + Next-Key Lock 已在很大程度上解决幻读。

- 数据一致性:RR 保证同一事务内多次读取结果一致。

少数场景选择 READ COMMITTED(读已提交):

- 减少锁冲突:RC 不使用间隙锁,只有行锁,高并发写入场景锁冲突更少。

- 数据实时性:RC 每次SELECT生成新 ReadView,能看到最新已提交数据。

- 阿里部分业务使用 RC,binlog 必须用 ROW 格式。

【大白话解释】 RR 像每个人拿到一份会议纪要的快照,整个会议期间都看这份;RC 像每次抬头看白板时都能看到最新内容。大多数场景 RR 更安全,但需要实时数据且写入频繁时 RC 更合适。

【扩展知识点详解】

- RR 的幻读陷阱:RR 并非完全消除幻读。快照读通过 MVCC 避免,但当前读可能看到新插入的行。

- 设置方式:

SET GLOBAL transaction_isolation = 'READ-COMMITTED';(MySQL 5.7+)。 - Oracle 默认 RC:迁移时需注意差异。

索引

【问题】 请简述MySQL常用的索引结构和索引类型有哪些种类?内部实现是怎样的?

【参考答案】 MySQL中索引是用于加速数据查询的数据结构,其核心作用类似于书籍的目录,能极大减少数据库需要扫描的数据量。MySQL支持多种索引结构,最常用的是B+树索引和哈希索引,此外还有全文索引、空间索引等。而索引类型则从逻辑角度划分,如主键索引、唯一索引、普通索引、全文索引、组合索引等。

一、常用的索引结构

- B+树索引

- 结构描述:B+树是一种平衡多路查找树,所有数据都存储在叶子节点,并且叶子节点之间通过双向链表连接,形成有序结构。非叶子节点只存储键值索引和指向子节点的指针。

- 内部实现:

- 每个节点对应一个磁盘页(默认16KB),通过页内二分查找快速定位。

- 插入和删除操作会触发节点的分裂或合并,以维持树的平衡。

- 叶子节点有序且链表相连,使得范围查询非常高效(只需遍历链表)。

- 适用场景:全值匹配、范围查询、排序、分组等。是InnoDB和MyISAM存储引擎的默认索引结构。

- 哈希索引

- 结构描述:基于哈希表实现,通过哈希函数将索引列的值映射到对应的槽位,快速定位数据行。

- 内部实现:

- 采用链地址法处理哈希冲突。

- 由于哈希表无序,无法用于范围查询和排序。

- 适用场景:仅支持等值查询(如

=、IN),且查询速度极快(O(1))。Memory引擎默认使用哈希索引,InnoDB支持自适应哈希索引(自动为热点页建立哈希索引,但不可人为干预)。

- 全文索引

- 结构描述:用于对文本内容进行关键词搜索,基于倒排索引实现。

- 内部实现:将文本分词后,记录每个词出现的位置和文档ID。

- 适用场景:

MATCH ... AGAINST语句,适合大文本字段的搜索,如文章内容。MyISAM和InnoDB(5.6+)均支持。

- 空间索引(R-Tree)

- 结构描述:用于地理空间数据类型,基于R树实现。

- 适用场景:GIS相关查询,如

ST_Distance等。MyISAM和InnoDB支持,但使用较少。

二、常用的索引类型(按逻辑划分)

- 主键索引(PRIMARY KEY):一种特殊的唯一索引,不允许空值。每个表只能有一个主键索引,InnoDB中主键即聚簇索引,直接存储行数据。

- 唯一索引(UNIQUE):索引列的值必须唯一,允许空值(但空值可重复,取决于数据库实现)。保证数据唯一性。

- 普通索引(INDEX):最基本的索引,没有任何限制,仅用于加速查询。

- 全文索引(FULLTEXT):用于全文搜索,如前所述。

- 组合索引(Composite Index):基于多个列的索引,遵循最左前缀原则。例如

(a,b,c)索引,可加速a、(a,b)、(a,b,c)的查询。

三、不同存储引擎的实现差异

- InnoDB:

- 索引即数据,聚簇索引(主键)的叶子节点存储整行数据,二级索引叶子节点存储主键值(因此回表需通过主键查找)。

- 支持自适应哈希索引(AHI),自动为频繁访问的索引页建立哈希索引以加速等值查询。

- 全文索引基于倒排表,支持中文分词(需插件)。

- MyISAM:

- 索引和数据分离,索引叶子节点存储数据行的物理地址(指针)。

- 不支持事务,但索引压缩特性在某些场景更省空间。

- Memory:

- 默认哈希索引,也可选择B+树索引,但数据易失。

【大白话解释于举例说明】

- B+树索引:就像图书馆的分类卡片柜,每个抽屉(节点)里放着卡片(键值),卡片上写着书名和书的位置。要找“Java编程思想”,先按首字母找抽屉,再按书名精确找卡片,最后按卡片指示去书架上拿书(数据)。要找“Java”开头的所有书,只需沿着卡片链一路找下去。

- 哈希索引:好比字典后面的偏旁部首表,直接告诉你某个字在第几页,非常快,但没法找“水”字旁的所有字(范围查询)。

- 全文索引:就像搜索引擎的倒排表,你搜“MySQL”,它告诉你哪些文档里有这个词。

【扩展知识点详解】

- B+树与B树的区别:B+树非叶子节点不存数据,能容纳更多键,树更矮,磁盘I/O更少;叶子节点链表便于范围扫描。

- 聚簇索引与二级索引:InnoDB中,数据行存储在聚簇索引中,二级索引需回表;覆盖索引可避免回表。

- 索引下推(ICP):将部分条件从Server层下推到存储引擎层,减少回表次数。

- 索引合并:多个索引同时使用,对结果集合并,但不如联合索引高效。

- 索引选择性:区分度高的列适合做索引,如唯一ID,而性别字段选择性差,索引效果不佳。

- 最左前缀原则:联合索引

(a,b,c)可匹配a、(a,b)、(a,b,c),但跳过中间列会导致部分失效。 - 索引优化建议:高频查询建索引、避免冗余索引、控制索引数量(影响写性能)、使用覆盖索引。

【问题】 MySQL建立索引的优势、影响与原则是什么?

【参考答案】 索引是数据库系统中用于加速数据查询的数据结构,合理使用索引能极大提升查询性能,但也存在一些负面影响。以下是索引的优势、影响和设计原则的详细说明。

一、索引的优势

- 加速数据检索:索引使数据库可以快速定位到满足条件的行,避免全表扫描,尤其对于大表效果显著。

- 保证数据的唯一性:通过唯一索引可以确保表中某列或多列的组合值唯一。

- 加速排序和分组:索引中数据已排序,能显著提高

ORDER BY和GROUP BY操作的效率。 - 使用覆盖索引避免回表:如果索引包含了查询所需的所有列,则无需回表读取完整行,减少I/O操作。

- 优化连接查询:在多表连接时,索引可以加速连接条件的匹配,提升

JOIN性能。 - 减少磁盘I/O:索引通常比数据行小,扫描索引比扫描全表需要的I/O更少。

- 支持唯一约束和主键:索引是实现主键和唯一约束的基础。

二、索引的影响(缺点)

- 占用额外存储空间:索引需要占用磁盘空间,如果索引过多,可能消耗大量存储。

- 降低写操作性能:当对表进行

INSERT、UPDATE、DELETE操作时,除了修改数据,还需要同步更新所有相关索引,导致写操作变慢。 - 增加维护成本:索引需要定期维护(如重建),且在数据量变化时可能产生碎片。

- 可能导致优化器选择错误:如果索引设计不合理,优化器可能选择低效的索引,反而降低性能。

- 创建索引本身耗时:在大表上创建索引可能需要较长时间,影响业务。

三、索引设计原则

- 选择性高的列优先:列中不同值的比例越高,索引效果越好。例如主键、唯一ID等。

- 频繁作为查询条件的列:在

WHERE、JOIN、ORDER BY、GROUP BY中经常出现的列应考虑建立索引。 - 使用联合索引时遵循最左前缀原则:联合索引

(a,b,c)可以支持a、(a,b)、(a,b,c)的查询,但跳过中间列会导致部分失效。 - 避免冗余索引:例如已有索引

(a,b),再建索引(a)就是冗余,因为前者可以覆盖后者。 - 控制索引数量:索引不是越多越好,一般单表建议不超过5-6个,平衡查询和写入性能。

- 小表可不建索引:对于记录很少的表,全表扫描可能比使用索引更快。

- 考虑前缀索引:对于很长的字符串列(如

VARCHAR(255)),可以使用前缀索引(如INDEX(name(10)))节省空间,但需权衡选择性。 - 利用覆盖索引:尽量让索引包含查询的所有列,避免回表。

- 索引列不宜参与计算:对索引列使用函数或表达式会导致索引失效,应避免。

- 主键尽量短小:InnoDB中主键是聚簇索引,过长的主键会使二级索引占用更多空间。

- 根据排序需求调整索引顺序:如果查询经常需要对某列排序,可将其放在联合索引的末尾(因为排序利用索引顺序)。

- 考虑数据分布:对于重复值很多的列(如性别),索引效果差,通常不建索引。

【大白话解释于举例说明】

- 优势:索引就像书的目录,让你直接翻到想看的那页,而不是一页页翻(全表扫描)。同时,目录也帮你按拼音排序,找同类词更快(排序和分组)。

- 影响:但目录本身也占书的页数(存储空间),每次书内容修改(增删改)都需要更新目录,所以写书变慢了。

- 原则:

- 给经常查找的词语建目录(频繁查询列)。

- 如果目录太长,只取前几个字建索引(前缀索引)。

- 一本书的目录不能太多(控制索引数量),否则找目录也费劲。

- 如果书很薄,干脆不要目录(小表不建索引)。

- 联合索引像多级目录:先按姓氏,再按名字,所以不能跳过姓氏直接查名字(最左前缀)。

【扩展知识点详解】

- 索引的底层实现:InnoDB使用B+树,叶子节点存储数据(聚簇索引)或主键值(二级索引)。理解B+树结构有助于优化索引设计。

- 索引选择性计算:选择性 = 列中不同值的数量 / 总行数。选择性越高,索引越有效。

- 三星索引概念:指索引满足三个条件:查询相关的列都在索引中(覆盖)、索引顺序与查询条件一致、索引排序与

ORDER BY一致,达到最优性能。 - 索引下推(ICP):将部分查询条件下推到存储引擎层,减少回表次数。

- 索引合并:MySQL在某些情况下会使用多个索引合并结果,但不如联合索引高效。

- MRR优化:Multi-Range Read,将随机回表改为顺序读,提升I/O效率。

- 索引碎片:频繁的增删改会导致索引碎片,可通过

OPTIMIZE TABLE或重建索引解决。 - 不可见索引:MySQL 8.0支持不可见索引,用于测试新索引效果而不影响实际查询。

- 函数索引:MySQL 8.0支持在表达式上建立索引,解决对列使用函数导致索引失效的问题。

- 索引监控:使用

SHOW INDEX FROM table查看索引信息,通过慢查询日志分析未使用索引的查询。

【问题】 MySQL中hash索引的底层数据结构是怎样的?它是怎么工作的?

【参考答案】 MySQL中的哈希索引主要基于哈希表(Hash Table)实现,是一种以键-值(key-value)方式存储的数据结构,通过哈希函数将索引列的值映射到特定的槽位(bucket)中,以实现快速等值查找。在MySQL中,哈希索引主要用于Memory存储引擎(显式创建)以及InnoDB存储引擎的自适应哈希索引(内部自动使用)。下面以Memory引擎的哈希索引为例详细说明。

一、底层数据结构 哈希索引的底层是一个数组,数组的每个元素称为一个哈希桶(bucket),每个桶指向一个链表的头部。当多个不同的键值经过哈希函数计算后得到相同的哈希码(即哈希冲突)时,这些键值会被存储在同一个桶对应的链表中。这种结构称为拉链法(或链地址法)解决冲突。

- 哈希函数:将输入的键(如索引列的值)转换为一个整数哈希码,然后通过取模运算(或其他映射)得到数组的索引位置。Memory引擎使用的哈希函数通常是对键值进行某种运算(如MySQL内置的哈希函数),力求分布均匀。

- 链表节点:每个节点存储了键值、指向实际数据行的指针(或主键值)以及指向下一个节点的指针。对于Memory引擎,由于数据本身存储在内存中,索引节点可以直接指向数据行的内存地址。

二、工作原理

- 插入操作

- 计算插入键的哈希值,通过哈希函数定位到对应的哈希桶。

- 检查该桶对应的链表中是否已存在相同键(避免重复,取决于索引是否唯一)。

- 将新的键值对(包含指向数据行的指针)插入到链表的头部或尾部(具体取决于实现,通常为头部以提高最近访问效率)。

- 如果链表过长,可能会影响查询性能,但哈希表通常通过调整数组大小(rehash)来保持负载因子在合理范围。Memory引擎的哈希索引在创建时固定了桶的数量(可通过

HASH_KEY_BUCKETS参数控制,但实际可能动态调整?Memory引擎的表在创建时指定MAX_ROWS等会影响桶数,但一般是静态的)。

- 查询操作(等值查询)

- 计算查询键的哈希值,定位哈希桶。

- 遍历该桶对应的链表,逐个比较键值,直到找到匹配的键或链表结束。

- 如果找到,则通过节点中存储的指针获取实际数据行;如果未找到,返回空。

- 时间复杂度理想情况下为O(1),最坏情况下(所有键映射到同一桶)退化为O(n)。

- 删除操作

- 定位哈希桶,在链表中找到对应节点,将其删除并调整链表指针。

三、哈希索引的特点

- 仅支持等值查询:包括

=、IN、<=>(安全等于),不支持范围查询(如<、>、BETWEEN)。 - 查询速度极快:理想情况下一次哈希计算即可定位,不需要像B+树那样进行多次I/O。

- 无法用于排序:因为哈希表中的数据不是按顺序存储的,所以无法用于

ORDER BY操作。 - 无法利用部分索引列:对于联合索引,哈希索引会使用所有索引列计算哈希值,不能只使用前缀列。例如,联合索引

(a,b),查询仅涉及a时无法使用哈希索引。 - 存储结构紧凑:哈希索引通常比B+树索引占用更少空间,但取决于哈希函数和负载因子。

四、哈希索引与B+树索引的对比

| 特性 | 哈希索引 | B+树索引 |

|---|---|---|

| 查询类型 | 等值查询 | 等值、范围、排序、分组 |

| 查询速度 | O(1) 理想 | O(log n) 稳定 |

| 索引列使用 | 必须所有列等值 | 支持最左前缀 |

| 排序支持 | 不支持 | 支持 |

| 冲突处理 | 链表或开放地址 | 树结构调整 |

| 适用引擎 | Memory(显式)、InnoDB(自适应) | InnoDB、MyISAM等 |

五、InnoDB的自适应哈希索引(AHI) InnoDB存储引擎内部维护了一个自适应哈希索引,它不是由用户创建的,而是InnoDB根据数据访问模式自动为频繁访问的索引页建立的哈希索引。目的是加速等值查询,减少B+树查找的路径。AHI使用索引键的前缀(如(space_id, page_no))构建哈希表,只针对热点页生效,对用户透明。

六、哈希索引的适用场景

- 适用于等值查询非常频繁且数据量可预估的场景,如缓存表、字典表。

- 在Memory引擎中,适合存储临时结果、中间数据。

- 不适合需要范围查询、排序或模糊匹配的业务。

【大白话解释于举例说明】 哈希索引就像一本新华字典的“拼音音节索引”,但只告诉你某个音节对应的字在哪一页。比如你想查“红”字,先按拼音“hong”找到对应的页码,然后直接翻到那一页(O(1))。但如果你想找所有拼音以“h”开头的字,哈希索引就无能为力了,因为那些字可能散落在各个页码,没有顺序。而B+树索引就像按笔画排序的目录,可以快速定位某个字,也可以找所有相同笔画的字(范围查询)。

在MySQL的Memory引擎里,哈希索引就像一张巨大的电话簿,每个姓名(键)通过算法计算出一个号码,然后放在对应编号的抽屉里。如果两个人算出的号码相同(冲突),就在同一个抽屉里用小纸条(链表)串起来。要找一个人,只需要计算号码,打开抽屉,顺着小纸条找。

【扩展知识点详解】

- Memory引擎的哈希索引参数:在创建表时可以指定

USING HASH来显式使用哈希索引,如CREATE TABLE ... INDEX idx USING HASH (col)。但Memory引擎也支持B+树索引(USING BTREE),默认是哈希索引。 - 哈希冲突的影响:当链表过长时,查询会退化为线性查找,可通过调整哈希函数或增加桶数量(rehash)来优化。Memory引擎在表创建时通过

MAX_ROWS估算桶数量,但不支持动态rehash,因此需合理预估数据量。 - 自适应哈希索引的监控:可通过

SHOW ENGINE INNODB STATUS查看AHI的使用情况,包括命中率等。 - 哈希索引的限制:在MySQL中,除了Memory引擎,NDB Cluster引擎也支持哈希索引。但InnoDB的哈希索引仅限内部自适应,用户无法直接创建。

- 哈希索引与唯一约束:唯一哈希索引可以保证键的唯一性,但冲突检查仍需遍历链表。

- 性能考量:哈希索引的查询性能与哈希函数均匀性、负载因子、链表长度相关。设计良好的哈希索引在等值查询上优于B+树,但写操作(插入/删除)可能因哈希冲突而变慢(需维护链表)。

- 与其他数据库的对比:例如PostgreSQL的哈希索引经过优化,支持WAL日志和崩溃恢复,而MySQL Memory引擎的哈希索引是非持久化的,数据易失。

- 使用建议:在需要高速缓存、会话级临时表等场景,可使用Memory引擎和哈希索引。对于持久化数据,应优先考虑InnoDB的B+树索引。

【问题】 讲一下你对MySQL中B 树 / B+ 树索引的了解,底层数据结构是怎样的?工作原理是什么?有什么优势?适用场景是什么?

【参考答案】 MySQL中的索引主要基于B+树(B-Tree的变种)实现,尤其是InnoDB存储引擎。B+树是一种平衡多路查找树,专为磁盘存储优化,能够高效支持等值查询、范围查询、排序和分组等操作。以下从底层数据结构、工作原理、优势及适用场景等方面详细阐述。

一、底层数据结构 B+树是一种多级索引结构,由根节点、内部节点(非叶子节点)和叶子节点组成。其核心特点如下:

- 节点:每个节点对应一个磁盘页(InnoDB默认16KB),节点内部包含多个键值(key)和指针(pointer)。

- 内部节点:仅存储键值和指向子节点的指针,不存储实际数据。这些键值用于引导搜索路径。

- 叶子节点:存储实际的数据行(对于聚簇索引)或主键值(对于二级索引)。所有叶子节点通过双向链表连接,形成有序结构,便于范围扫描。

- 平衡性:树始终保持平衡,所有叶子节点在同一层,从根到叶子的路径长度相同。

在InnoDB中,聚簇索引(主键索引)的叶子节点直接存储整行数据;二级索引的叶子节点存储索引列的值和对应的主键值,回表需通过主键查询聚簇索引。

二、工作原理

- 查找过程:从根节点开始,通过二分查找定位到键值所在的指针范围,逐层向下,直到到达叶子节点。在叶子节点中,进一步查找具体的键值,如果找到则获取对应的数据或主键。

- 范围查询:由于叶子节点通过链表有序连接,当需要查找某个范围内的数据时,先找到范围起始点,然后沿着链表顺序遍历直到结束,无需回溯树结构。

- 插入与删除:插入新键时,会先定位到对应的叶子节点,如果节点未满则直接插入;否则进行节点分裂,将中间键提升到父节点,并可能递归分裂。删除操作类似,可能导致节点合并。

- 维护平衡:通过分裂、合并等操作确保树的高度始终稳定(通常为2-4层),从而保证查询性能的稳定性。

三、B+树的优势

- 磁盘I/O优化:每个节点大小与磁盘页对齐,一次I/O可读取整个节点。树的高度较低(通常2-4层),意味着查找数据只需少量I/O操作,远少于全表扫描。

- 支持高效范围查询:叶子节点的链表结构使得范围扫描只需顺序读取,无需多次遍历树。

- 数据有序存储:索引天然有序,能够加速

ORDER BY和GROUP BY操作,避免文件排序。 - 高扇出性:内部节点不存储数据,仅存键和指针,因此每个节点能容纳更多键,降低树的高度。

- 稳定性能:所有查询(包括等值和范围)的时间复杂度均为O(log n),不会因数据分布不均而波动。

- 支持覆盖索引:如果查询的列全部在索引中(二级索引),则无需回表,进一步提升性能。

四、适用场景 B+树索引适用于以下场景:

- 全值匹配查询:如

WHERE id = 123。 - 范围查询:如

WHERE age BETWEEN 20 AND 30、WHERE name LIKE 'abc%'。 - 排序和分组:

ORDER BY、GROUP BY可以利用索引的顺序。 - 连接查询:在多表

JOIN时,连接列上的索引能加速匹配。 - 覆盖索引:查询字段全部包含在索引中时,直接使用索引返回结果。

- 唯一性约束:主键索引和唯一索引保证数据唯一性。

【大白话解释于举例说明】

- 底层数据结构:想象一本新华字典的“部首检字表”。根节点就像字典的“部首目录”,告诉你某个部首在哪一页;内部节点就像每一页上的小索引,指引你进一步查找;叶子节点就像最终的词条页,上面写着字的解释(数据)。所有词条页按拼音顺序排列,并相互链接,方便你查找相邻的字(范围查询)。

- 工作原理:你想查“张”字,先看“部首目录”找到“弓”字部在第几页,然后翻到那一页,在“弓”部列表中找到“张”对应的页码,最后翻到该页看到“张”的解释。每一步都像在树中向下走一层。

- 优势:因为目录(内部节点)只存部首和页码,很薄,所以翻得快;而词条页(叶子节点)按顺序排,要找“张”到“章”之间的字,只需顺着页边找,不用来回翻。

- 适用场景:适合精确查找(比如查某个字),也适合找所有同部首的字(范围查询),还能按拼音排序(比如给字表排序)。

【扩展知识点详解】

- B树与B+树的区别:

- B树的每个节点都存储数据,导致内部节点空间占用大,扇出低,树更高。

- B+树只有叶子节点存数据,内部节点仅存键,扇出高,树更矮;且叶子节点链表便于范围扫描。

- InnoDB中索引的实现:

- 聚簇索引:主键索引即聚簇索引,叶子节点存整行数据,表数据按主键顺序物理存储。

- 二级索引:非主键索引,叶子节点存索引列和主键值,查询时需回表(除非覆盖索引)。

- 自适应哈希索引:InnoDB会为频繁访问的索引页建立哈希索引,加速等值查询。

- B+树的层高计算:假设一行数据1KB,一个16KB页可存约15行,每个键值对占用几十字节,内部节点可存几百个键。对于2千万行的表,树高通常为3层,查询只需3次I/O。

- 索引维护开销:插入、删除可能导致页分裂或合并,产生写放大,但B+树通过缓冲池和后台操作减轻影响。

- B+树在磁盘上的组织:InnoDB通过表空间管理页,每个页有唯一编号,指针存储为页号+偏移量。

- 与LSM树对比:LSM树(如LevelDB、RocksDB)适用于写多读少场景,而B+树更适合读多写少。

- 优化技巧:利用最左前缀原则设计联合索引;避免对索引列使用函数;合理选择索引列顺序等。

【问题】 什么是MySQL的覆盖索引?

【参考答案】 覆盖索引(Covering Index)是指一个索引包含了查询所需的所有列(即查询的字段都在索引中),使得查询只需要扫描索引而无需回表(访问数据行)就能得到结果。在MySQL中,可以通过EXPLAIN命令的输出中,如果Extra列显示Using index,则表示该查询使用了覆盖索引。覆盖索引能显著提升查询性能,因为索引通常比数据行小,且顺序存储,可以减少I/O操作。需要注意的是,只有B-Tree索引(包括InnoDB的聚簇索引和二级索引)能实现覆盖索引,而哈希索引、空间索引、全文索引等由于不存储完整的列值,无法用作覆盖索引。

【大白话解释于举例说明】 可以把索引想象成一本书的目录,数据行是书的内容。普通查询就像按目录找到页码后,还要翻到对应的页去读内容(回表)。而覆盖索引就像目录里直接写了你想要的所有信息,比如目录里除了标题还有作者和出版年份,你只需要查目录就能得到答案,根本不用翻到正文。

例如,假设有一张用户表user:

1

2

3

4

5

6

7

CREATE TABLE user (

id INT PRIMARY KEY,

name VARCHAR(50),

age INT,

address VARCHAR(100),

INDEX idx_name_age (name, age)

);

执行查询:

1

SELECT name, age FROM user WHERE name = '张三';

因为name和age都在联合索引idx_name_age中,MySQL可以直接从索引中获取这两列的值,无需读取整行数据。使用EXPLAIN查看,Extra列会显示Using index,说明用到了覆盖索引。

如果换成SELECT * FROM user WHERE name = '张三',索引中不包含address,就需要回表取数据,就无法使用覆盖索引。

【扩展知识点详解】

判断覆盖索引的方法

通过EXPLAIN分析查询,如果Extra列出现Using index,则表明使用了覆盖索引。注意Using index与Using where的区别:Using index表示直接通过索引获取数据,而Using where表示在索引层过滤后还需要回表检查条件。覆盖索引的工作原理

MySQL在B+Tree索引中,叶子节点存储了索引列的值以及指向数据行的指针(对于二级索引,叶子节点包含索引列和主键值)。如果查询的所有列都包含在索引列中,优化器会选择仅扫描索引,避免回表产生的随机I/O,大幅提升查询速度。- 覆盖索引的优缺点

- 优点:减少I/O操作(索引通常比数据行小,且按顺序存储);避免聚簇索引的回表开销;对于InnoDB,如果覆盖索引包含了主键,甚至可以避免二次查找(因为二级索引叶子节点存储主键值)。

- 缺点:索引本身占用更多存储空间;维护成本增加(写操作需更新索引);并非所有查询都能设计覆盖索引。

- 适用场景

- 高频查询且返回字段较少时,可创建覆盖索引优化。

- 统计类查询(如

COUNT(*))若能用覆盖索引也会更快。 - 需要排序的查询,若索引包含排序字段,也可能避免文件排序。

与聚簇索引的关系

在InnoDB中,聚簇索引(主键索引)的叶子节点直接存储整行数据,因此任何SELECT只要通过主键查询,天然就是“覆盖”的,因为索引本身包含了所有列。但二级索引需要回表,只有二级索引包含所有查询列时才能实现覆盖。- 注意事项

- 覆盖索引要求查询列必须全部在索引中,因此

SELECT *通常无法使用覆盖索引,除非索引包含了所有字段(例如创建了包含所有列的联合索引,但这样索引体积过大,不推荐)。 - 在MySQL中,只有B-Tree索引(包括InnoDB和MyISAM)支持覆盖索引;哈希索引、空间索引、全文索引等无法实现覆盖索引,因为它们不存储原始列值。

- 使用

EXPLAIN时,如果Extra显示Using index condition,则代表使用了索引条件下推(ICP),与覆盖索引不同,后者是直接在索引层完成所有数据获取。

- 覆盖索引要求查询列必须全部在索引中,因此

- 设计覆盖索引的原则

- 将查询中经常出现的字段(尤其是

WHERE、SELECT、ORDER BY、GROUP BY涉及的字段)纳入联合索引。 - 注意索引字段的顺序,尽量满足最左前缀原则。

- 平衡查询性能与索引维护成本,避免创建过宽的索引。

- 将查询中经常出现的字段(尤其是

【问题】 造成索引失效的场景有哪些?

【参考答案】 MySQL中索引失效(即查询无法使用索引或优化器放弃使用索引)的常见场景包括:

- 违反最左前缀原则:对于联合索引,查询条件未从索引的最左列开始,或跳过中间列,导致部分索引无法使用。

- 对索引列使用函数或计算:在

WHERE子句中对索引列进行函数操作(如DATE()、LENGTH())或表达式计算(如col+1),会使索引失效。 - 隐式类型转换:当索引列的类型与查询条件的类型不一致时,MySQL会进行隐式转换,导致索引失效(例如字符串列与数字比较)。

- 模糊查询以通配符开头:使用

LIKE '%abc'或LIKE '_abc'时,无法使用索引(但LIKE 'abc%'可以使用索引)。 - 使用

OR连接条件:如果OR两边的条件中,有一边的列没有索引,或虽然都有索引但MySQL优化器认为扫描全表更优,则可能放弃索引。 - 使用

!=或<>操作符:不等于比较通常会让索引失效,除非查询的数据分布非常特殊(例如主键范围扫描)。 IS NULL或IS NOT NULL:对于某些存储引擎(如InnoDB),IS NULL可能使用索引,但IS NOT NULL通常导致索引失效,尤其是当NULL值占比很小时。- 全表扫描比索引更快:当优化器估算发现使用索引需要访问大量数据(例如超过表的30%左右),可能会放弃索引而选择全表扫描(如范围查询数据量过大时)。

ORDER BY与索引顺序不匹配:如果ORDER BY的字段顺序与索引顺序不一致,或同时包含ASC和DESC混用,可能无法利用索引排序。SELECT *且无覆盖索引:当查询所有列且索引不包含全部列时,需要回表,如果回表代价高,优化器可能放弃索引。- 使用

NOT IN、NOT EXISTS:这些操作通常导致索引失效,转为全表扫描。 - 对索引列进行参数化查询但参数类型不匹配:例如PreparedStatement中设置参数类型与字段类型不一致,导致隐式转换。

【大白话解释于举例说明】 可以把索引想象成书的目录,索引失效就是明明有目录却无法用,只能一页页翻书。

- 最左前缀原则:比如联合索引是

(a, b, c),就像目录先按a排,再按b,再按c。你只查b和c,目录就帮不上忙;或者查a和c,跳过b,那么a能用,c用不了(因为中间跳过了b)。1 2

WHERE b = 2; -- 索引失效 WHERE a = 1 AND c = 3; -- 只有a能用,c不能(需要先按b定位)

- 函数计算:比如你在目录里找作者,但条件写的是

LENGTH(name)=5,这就相当于把名字改成了长度,目录就没办法直接定位。1

WHERE LENGTH(name)=5; -- 索引失效

- 类型转换:比如手机号字段是

varchar,但你用数字查WHERE phone = 13800138000,MySQL会先把所有phone转成数字再比,索引就废了。1

WHERE phone = 13800138000; -- 隐式转换,索引失效

- LIKE以%开头:你要找名字里带“三”的人,写

LIKE '%三%',就像在目录里找第二个字是“三”的,没法直接定位,只能翻遍整本书。1

WHERE name LIKE '%三%'; -- 索引失效

- OR条件:比如

WHERE age=20 OR name='张三',如果age有索引但name没有,那只能用全表扫,因为部分数据还是要查表。1

WHERE age=20 OR name='张三'; -- 如果name无索引,全表扫描

- 不等于:

WHERE age != 20,就像要找所有不是20岁的人,如果年龄分布很广,数据库觉得还不如全表扫一遍。1

WHERE age <> 20; -- 通常索引失效

- IS NULL/IS NOT NULL:

WHERE name IS NULL,对于大多数情况,NULL值很少,用索引找很快;但IS NOT NULL要排除NULL,如果大部分都不是NULL,还不如全表扫。1

WHERE name IS NOT NULL; -- 可能索引失效

- 优化器估算:比如你要查价格大于100的商品,如果超过30%的商品都大于100,那用索引还不如直接全表扫,因为索引加回表更慢。

1

WHERE price > 100; -- 如果数据量大,可能走全表扫描

- ORDER BY顺序不匹配:索引是

(a, b),但ORDER BY b, a,就像目录先按a排,你要按b排,就没法直接利用。1

ORDER BY b, a; -- 索引失效(需filesort)

- SELECT * 无覆盖索引:

SELECT * FROM user WHERE age=20,如果索引只有age,那找到age=20的记录后还要回表取其他字段,如果回表太多,不如全表扫描。

【扩展知识点详解】

最左前缀原则的细节:联合索引的匹配遵循从左到右的顺序,一旦跳过某一列,后面的列无法使用索引。此外,范围查询(

>、<、BETWEEN)也会导致后续列索引失效(但范围列本身仍能用)。例如WHERE a>1 AND b=2,a能用到索引,b不能(因为a是范围),这是索引使用而非失效。函数索引与虚拟列:MySQL 5.7+支持虚拟列,可以在虚拟列上建立索引以解决对列使用函数的问题。8.0+支持函数索引(直接对表达式建立索引),从而避免索引失效。

隐式类型转换规则:当字符串和数字比较时,MySQL会将字符串转换为数字(而非数字转字符串)。例如

phone='13800138000'(字符串)用索引,而phone=13800138000(数字)会导致全表扫描。日期类型与字符串比较也可能发生转换。OR条件的优化:如果OR所有条件列都有索引,MySQL可能使用索引合并(Index Merge)来优化,但效率不一定高。尽量改为

UNION或IN(如果可能)。优化器成本估算:MySQL通过抽样统计信息估算行数,当估算读取行数超过全表一定比例(通常10%-30%),就会放弃索引。这可以通过

FORCE INDEX强制使用,但不推荐生产环境使用。排序与索引:如果

ORDER BY字段和WHERE条件字段可以组成联合索引,可能避免文件排序。例如WHERE a=1 ORDER BY b,索引(a,b)可以完美支持。但如果ORDER BY和GROUP BY混合使用,也可能导致索引失效。覆盖索引与回表:当使用覆盖索引时,即使查询条件不符合最左前缀(只要索引包含了所有字段),也可能使用索引(Extra显示

Using index)。但覆盖索引不能完全避免索引失效,例如WHERE b=2在索引(a,b)上,虽然b不是最左,但若查询字段只有b,仍可能使用索引扫描(但效率低,因为需要扫描整个索引)。这算不算索引失效?严格来说索引被使用了,但不是高效的访问方式,优化器可能放弃。统计信息过时:如果表的统计信息不准确,优化器可能错误地选择全表扫描。可通过

ANALYZE TABLE更新统计信息。分区表:分区表的索引失效可能涉及分区裁剪失败,需注意分区键的使用。

锁与并发:某些锁操作(如

LOCK TABLES)可能导致索引使用受限,但一般不常见。索引不可见:MySQL 8.0支持不可见索引,优化器不会使用,相当于人为使索引失效。

优化建议:

- 定期使用

EXPLAIN分析查询,关注type、key、Extra列。 - 为高频查询设计合适的联合索引,考虑字段顺序。

- 避免在索引列上做计算、函数、类型转换,必要时使用冗余字段或函数索引。

- 使用

LIKE时,尽量将通配符放在右侧。 - 对于

OR,考虑拆分为UNION或使用IN(如果集合较小)。 - 监控慢查询日志,针对性的优化。

注意:以上场景并非绝对,MySQL优化器会根据实际情况(数据分布、统计信息、索引成本)做出判断,因此“索引失效”是一个动态结果。

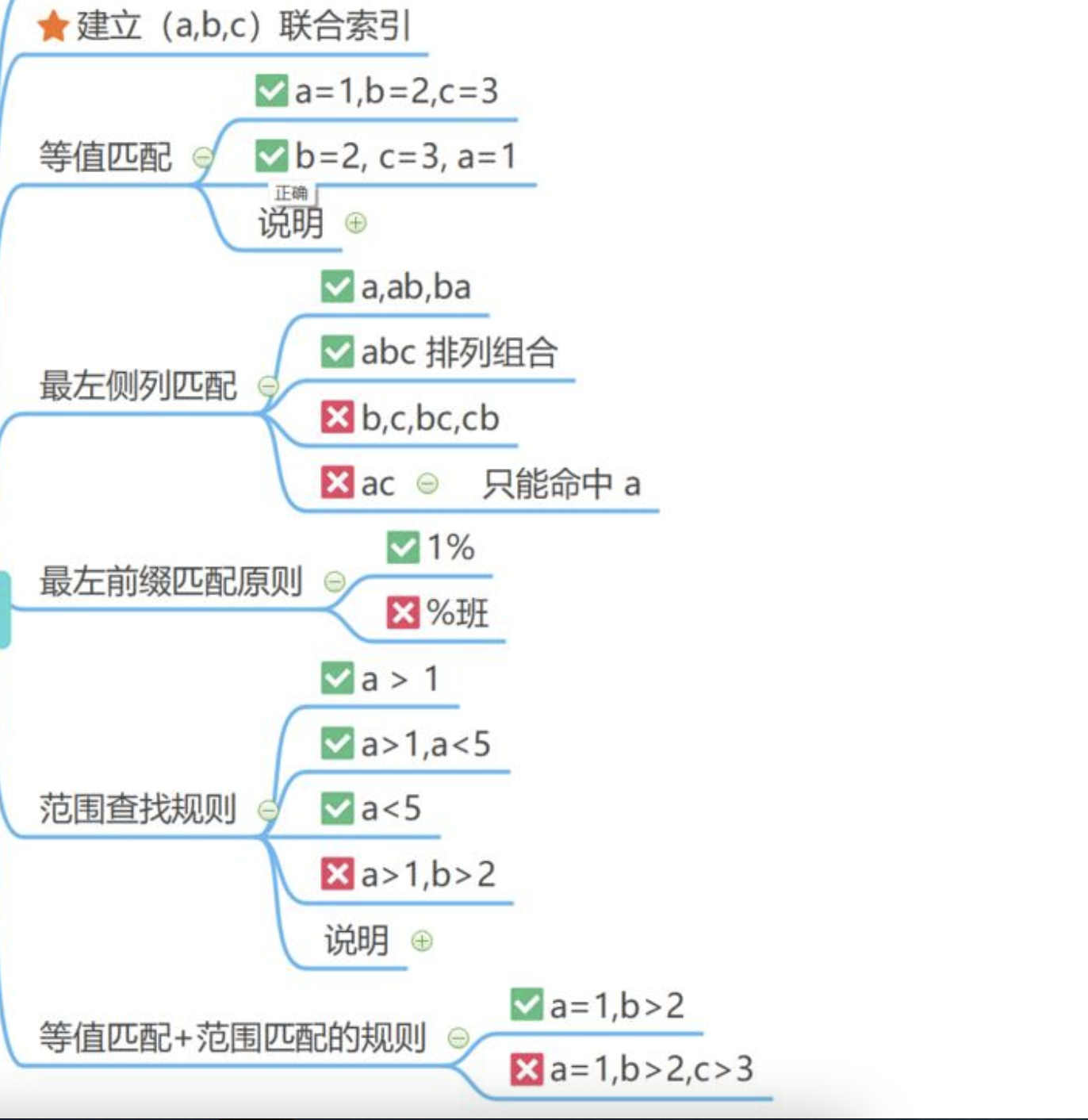

【问题】 联合索引的匹配规则有哪些?

【参考答案】 联合索引(也称为复合索引)的匹配规则主要遵循最左前缀原则,并结合查询条件的使用方式决定索引是否能被有效利用。具体规则如下: 全值匹配我最爱,最左前缀要遵守; 带头大哥不能死,中间兄弟不能断; 索引列上少计算,范围之后全失效; like百分写最右,覆盖索引不写星; 不等空值还有or,索引失效要少用; var引号不能丢,索引规则也不难;

- 全值匹配:查询条件中的字段与联合索引的所有列完全匹配(即等值比较),且顺序与索引定义一致时,索引效率最高。

- 最左前缀原则:查询必须从联合索引的最左侧列开始,并且不能跳过中间的列。只有满足最左前缀的查询部分才能使用索引。

- 如果查询条件中缺失最左侧列,则无法使用该索引。

- 如果跳过中间列,那么只能使用索引中从最左侧到跳过列之前的部分,后续列无法利用索引。

- 范围查询导致后续列失效:当查询条件中出现范围查询(

>、<、BETWEEN、LIKE等)时,该列可以使用索引,但其后的列无法继续使用索引(即索引只能用于范围列本身及其前面的列)。 - 对索引列使用函数或计算会使索引失效:如果在索引列上进行函数操作或表达式计算(如

LENGTH(col)、col+1),则该列无法使用索引,进而可能导致整个索引无法使用(除非满足最左前缀的其他列仍可用)。 - LIKE查询以通配符开头会导致索引失效:

LIKE '%abc'或LIKE '_abc'无法使用索引,但LIKE 'abc%'可以使用索引(属于范围查询的一种)。 - 索引列的类型转换会导致索引失效:如果查询条件中的数据类型与索引列的数据类型不一致(例如字符串列与数字比较),MySQL会进行隐式类型转换,导致该列索引无法使用。

- 使用

OR连接条件可能导致索引失效:如果OR两边的条件中,有一边不是索引列或MySQL认为全表扫描更优,则可能放弃使用索引。 - 使用

!=、<>、NOT IN等否定操作符通常使索引失效,除非优化器判断使用索引成本更低(如查询大部分数据时)。 IS NULL和IS NOT NULL:对于IS NULL,如果NULL值较少,可能使用索引;IS NOT NULL通常导致索引失效(当非NULL值占多数时)。- 排序(

ORDER BY)与索引匹配:如果ORDER BY的字段顺序与联合索引一致,且排序方向相同,则可以利用索引避免文件排序。但若顺序不一致或存在混合排序方向,则无法使用索引排序。 - 覆盖索引可以绕过部分限制:如果查询的字段全部包含在联合索引中(即覆盖索引),即使某些条件不满足最左前缀,也可能通过扫描整个索引来获取数据(但效率可能低于全值匹配)。

【大白话解释于举例说明】 假设有一张学生表,创建了联合索引(name, age, class)。下面用通俗语言解释规则:

- 全值匹配:就像你按姓名、年龄、班级三个条件精确找人,索引一步到位。

1

SELECT * FROM student WHERE name='张三' AND age=18 AND class='一班'; -- 完美使用索引

- 最左前缀:索引像电话簿先按姓氏、再按名字排序。你只知道名字不知道姓氏,就找不到;或者你知道姓氏和班级,但跳过年龄,那么班级条件用不上(因为年龄没确定,无法在年龄范围内精确找班级)。

1 2

WHERE age=18 AND class='一班'; -- 没从name开始,索引失效(全表扫描) WHERE name='张三' AND class='一班'; -- name能用,class不能用(跳过了age)

- 范围后失效:比如你找姓“张”且年龄大于18的,

name的等值条件可以用索引,age的范围条件也能用,但age后面的class条件就只能在筛选出的数据中再过滤,无法利用索引快速定位了。1

WHERE name='张三' AND age>18 AND class='一班'; -- name和age用索引,class不能

函数/计算:如果条件写成

WHERE LEFT(name,1)='张',相当于把名字改了,索引就没法用了。LIKE通配符:

WHERE name LIKE '张%'能用索引(相当于范围),但%张不行。类型转换:如果

name是字符串,你用数字查WHERE name=123,MySQL会把所有name转成数字再比,索引失效。OR:

WHERE name='张三' OR age=18,如果age没索引,那即使name有索引,也可能全表扫描。不等于:

WHERE age != 18,要找所有不是18岁的,数据库觉得全表扫更快。IS NULL:

WHERE name IS NULL如果确实有NULL值,可能用索引(但效率一般);IS NOT NULL通常不用索引。排序:

ORDER BY name, age, class可以用索引排序;但ORDER BY age, name顺序不对,需要文件排序。- 覆盖索引:如果只查

name,age(都在索引里),即使条件只有age=18(不符合最左),也可能扫描整个索引得到结果(Extra显示Using index),但比全表扫描快。

【扩展知识点详解】

联合索引在B+树中的存储结构

联合索引的B+树按照索引定义的列顺序依次排序。例如索引(a,b,c),先按a排序,a相同的按b排序,b相同的按c排序。因此,只有遵循最左前缀的查询才能高效地定位数据。最左前缀原则的数学原理

因为索引树的排序规则,如果查询条件中不包含最左列,就无法确定在树中搜索的起始范围,只能全索引扫描。例如,查找所有b=2的记录,由于a未知,必须遍历整个索引树,相当于全表扫描(但扫描索引比扫描表稍快)。范围查询后列失效的原因

当使用范围查询时(如a>1),满足条件的a值有很多,对于每个不同的a,b和c的排序规则只在a确定的子树内有效。因此,范围查询后的列无法继续用于精确查找,只能对结果集进行过滤。MySQL 8.0引入了索引下推(ICP),可以将部分条件推送到存储引擎层过滤,但依然无法避免扫描。索引下推(Index Condition Pushdown)

MySQL 5.6+支持ICP,允许在存储引擎层过滤不符合后续索引列条件的数据,减少回表次数。例如WHERE name='张三' AND age>18 AND class='一班',在ICP下,class条件会在读取索引时判断,只有满足class='一班'的才回表,但class本身并未用于索引定位。索引选择性与优化器成本估算

优化器会根据统计信息估算不同执行计划的成本(包括IO和CPU)。即使存在可用索引,如果优化器认为全表扫描成本更低(如返回数据量占比较大),也会放弃索引。这是索引“失效”的另一层含义,并非索引本身不能用,而是优化器选择了更优方案。排序与索引的关系

如果ORDER BY的字段顺序与索引完全一致,且排序方向相同,则MySQL可以直接利用索引的有序性避免文件排序(filesort)。如果查询中同时包含WHERE和ORDER BY,索引设计应尽量同时满足两者(例如将WHERE的等值列放在前面,ORDER BY列放在后面)。- 索引设计原则

- 选择区分度高的列作为索引前列。

- 将经常用于

WHERE条件、JOIN连接、ORDER BY、GROUP BY的列纳入联合索引。 - 考虑查询频率和更新开销,避免过多索引。

- 对于范围查询频繁的场景,可将范围列放在索引最后,以避免影响后续列。

- 特殊情况处理

- IN查询:

IN在MySQL中通常当作多个等值比较,如果IN列表值不多,可以使用索引,且不会导致后续列失效(但IN之后的范围列依然可能失效)。 - OR条件的优化:若

OR两边列都有独立索引,MySQL可能使用索引合并(Index Merge),但效率通常不如联合索引。 - 函数索引:MySQL 8.0支持在表达式上创建索引,可以解决对列使用函数导致的失效问题。

- 隐式转换规则:当字符串与数字比较时,MySQL将字符串转为数字(例如

'123'转123),若字符串列有索引,转换后索引失效。

- IN查询:

验证方法

使用EXPLAIN分析查询,关注key(实际使用的索引)、key_len(使用的索引长度)、ref(哪些列或常量用于查找)、Extra(Using where、Using index、Using index condition等)。例如key_len可以推断出使用了联合索引中的哪些列。- 常见误区

- 误区:只要查询涉及索引列,就会使用索引。实际上,必须遵循最左前缀。

- 误区:范围查询一定导致后续列失效。注意,如果范围条件是等值

=,则后续列可以继续使用;范围(>、<)才会阻断。 - 误区:

LIKE '%abc'一定不用索引。在少数情况下,如果查询只返回索引列(覆盖索引),且优化器认为索引扫描成本低于全表扫描,仍可能使用索引(但效率较低)。

理解联合索引的匹配规则是SQL优化的基础,实际应用中需结合具体查询和数据分布,通过EXPLAIN分析调整索引设计。

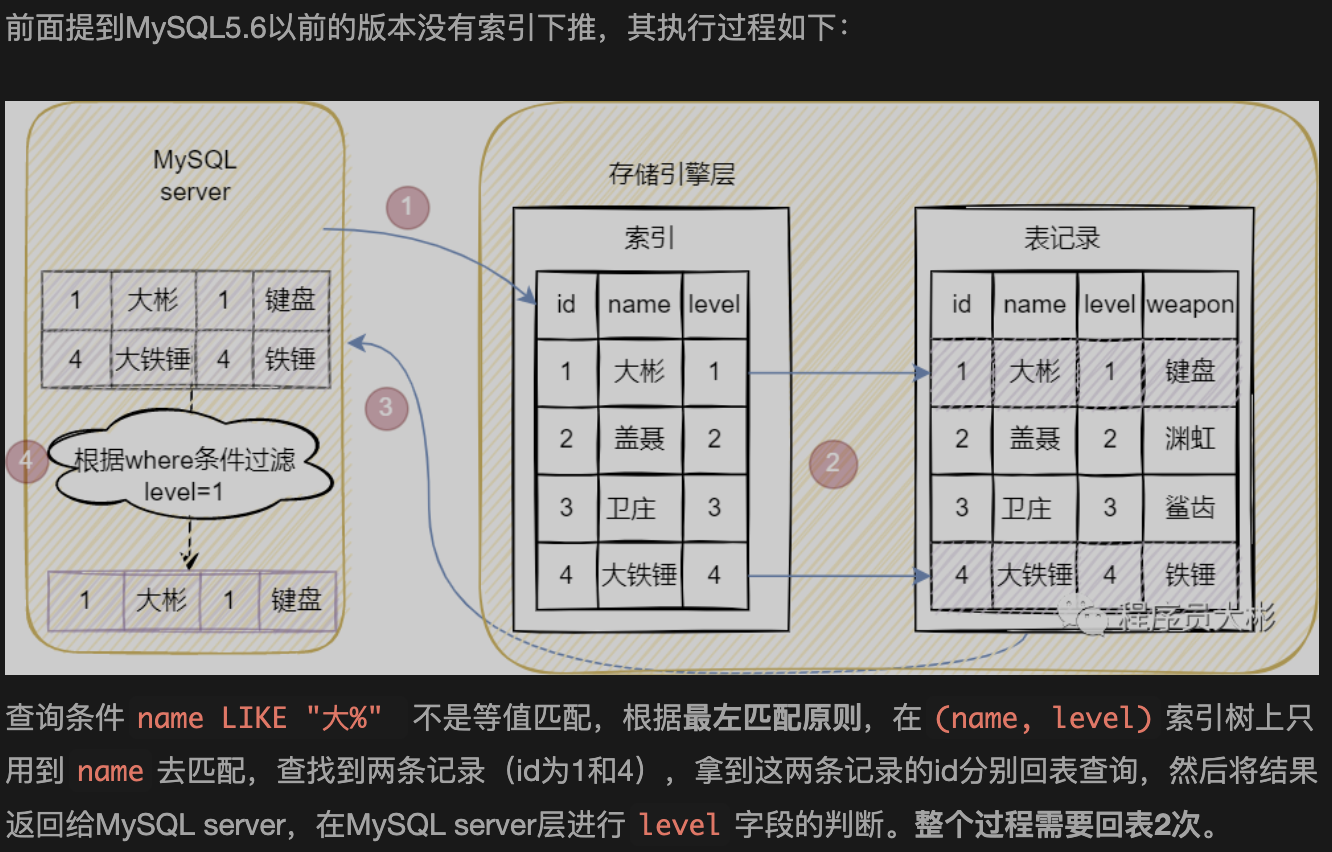

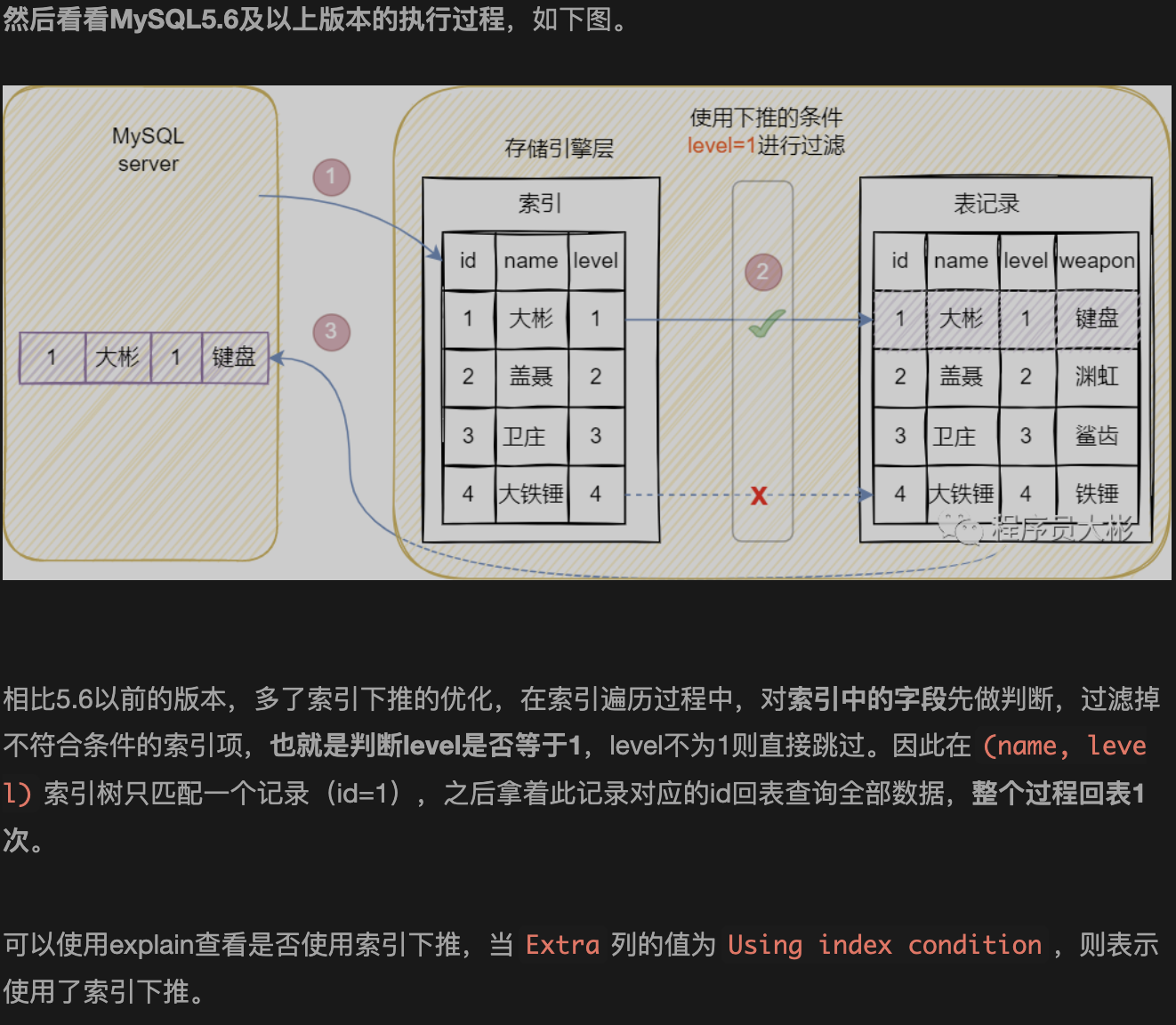

【问题】 MySQL的索引下推是什么?

【参考答案】 索引下推(Index Condition Pushdown,简称ICP)是MySQL 5.6版本引入的一种查询优化技术,旨在减少使用二级索引查询时的回表次数,提升查询性能。其核心思想是将部分查询条件下推到存储引擎层,在存储引擎层利用索引列进行数据过滤,只将满足条件的索引记录返回给Server层,从而避免对不满足条件的记录进行回表操作。

在ICP引入之前,MySQL使用二级索引查询的流程为:存储引擎通过索引找到记录(先读取索引记录,再根据主键回表读取完整行数据),然后将完整行数据返回给Server层,Server层再对记录进行WHERE条件的过滤。这种模式下,即使索引记录最终不满足WHERE条件,也会发生回表,造成不必要的I/O开销。

引入ICP后,如果查询条件中包含索引列的条件,Server层会将这部分条件下推到存储引擎,存储引擎在读取索引记录时,直接根据下推的条件进行判断,只有满足条件的索引记录才进行回表操作,否则跳过。这样就减少了回表次数,提高了查询效率。

ICP默认开启,可通过optimizer_switch系统变量控制,并使用EXPLAIN查看执行计划时,若Extra列显示Using index condition,则表示使用了索引下推。

【大白话解释于举例说明】 可以把索引比作图书馆的图书目录卡片,数据行比作书架上的实体书。传统查询就像:根据目录卡片找到一本书的编号,然后去书架取回整本书,再翻开看内容是否符合条件(比如作者或年份)。如果不符合,这本书就白取了,还得放回去,浪费体力。

索引下推就像:在查目录卡片时,卡片上已经记录了部分信息(比如作者),你可以先根据卡片上的信息筛选掉明显不符合的书,只把符合条件的书编号记下来,再去书架上取书。这样你只需要取回真正需要的书,避免了无效的搬书劳动。

具体例子: 假设有一张用户表user,有联合索引(age, name),查询语句:

1

SELECT * FROM user WHERE age > 20 AND name LIKE '%三%';

在没有ICP时,存储引擎会根据age > 20找到所有符合条件的索引记录(包含主键),然后逐个回表读取完整行,Server层再对name进行LIKE匹配。即使很多行name不满足条件,也会发生回表。

有了ICP后,Server层将name LIKE '%三%'下推到存储引擎,存储引擎在扫描索引时,对每个索引记录先判断name是否匹配(因为索引中包含了name列),只有匹配的才回表。这样大大减少了回表次数。

【扩展知识点详解】

- ICP的工作原理

- 当使用二级索引进行范围扫描或等值扫描时,如果查询条件中除了索引列还有额外的索引列条件,MySQL会将这部分条件(即可以使用索引列进行判断的条件)传递给存储引擎。

- 存储引擎遍历索引时,对每个索引条目先检查下推的条件,如果满足则根据索引中的主键进行回表;如果不满足则直接跳过,无需回表。

- ICP主要适用于二级索引,因为聚簇索引本身包含了整行数据,无需回表。

- ICP的适用条件

- 只能用于二级索引,不能用于聚簇索引(主键索引)。

- 需要访问完整行记录(即查询需要回表),如果查询已通过覆盖索引完成(

Extra显示Using index),则ICP不生效。 - 下推的条件必须是索引列的条件,且不能包含子查询、非索引列、函数(但某些情况如

LIKE前缀匹配也可能下推)。 - 适用于InnoDB和MyISAM存储引擎。

- 需要优化器评估使用ICP的成本低于不使用ICP。

- 如何查看是否使用了ICP

- 使用

EXPLAIN分析查询,如果Extra列显示Using index condition,则说明使用了索引下推。 - 也可以通过

optimizer_switch变量查看ICP状态:SHOW VARIABLES LIKE 'optimizer_switch';,其中index_condition_pushdown=on表示开启。

- 使用

- ICP与覆盖索引的区别

- 覆盖索引(

Using index)是指查询所需的所有列都在索引中,无需回表。 - ICP(

Using index condition)则仍需回表,但减少了回表的次数。两者可同时出现?实际上Extra中不会同时出现Using index和Using index condition,因为如果覆盖索引生效,就无需回表,ICP就没有意义了。但可能存在Using index condition和Using where同时出现的情况,表示ICP过滤了一部分,Server层再过滤剩下的。

- 覆盖索引(

- ICP的优化效果

- 减少回表次数,降低随机I/O开销。

- 尤其适用于索引列选择性较差、需要回表大量记录但实际满足条件的记录较少的情况。

- 对于

LIKE模糊查询(只要通配符不在最左)、范围查询等场景效果明显。

- ICP的局限性

- 只能下推索引列的条件,对于非索引列的条件无法下推,仍需Server层过滤。

- 如果查询中使用了函数或表达式在索引列上,导致索引列无法直接用于判断,则无法下推(除非MySQL 8.0支持函数索引后,对函数索引列的条件可能下推)。

- 在某些情况下,优化器可能认为使用ICP成本更高(例如索引扫描本身需要大量读取),而选择不使用。

- ICP与索引条件下推的历史

- MySQL 5.6首次引入ICP。

- MySQL 5.7、8.0持续优化,对更多类型的查询支持ICP,包括分区表的ICP等。

- 相关参数

optimizer_switch中的index_condition_pushdown可以动态开启或关闭ICP:1

SET optimizer_switch = 'index_condition_pushdown=off';

- 示例分析

假设表结构:1

CREATE TABLE t1 (a INT, b INT, c INT, KEY idx_a_b (a, b));

查询:

1

SELECT * FROM t1 WHERE a > 10 AND b = 5;

- 无ICP:存储引擎通过索引找到所有

a>10的记录(索引项包含a,b和主键),回表获取完整行,Server层再过滤b=5。 - 有ICP:存储引擎在扫描索引时,对于每个

a>10的记录,先检查b=5(因为b也在索引中),只有b=5的才回表。

- 无ICP:存储引擎通过索引找到所有

- 与其他优化的配合

- ICP可以与MRR(Multi-Range Read)配合使用,进一步优化回表的磁盘读取顺序,将随机I/O转为顺序I/O。

- 在MySQL 8.0中,ICP还支持对派生表(Derived Table)的下推等。

总之,索引下推是MySQL重要的性能优化特性,理解其原理有助于编写高效SQL和设计索引,并在分析执行计划时准确判断查询是否充分利用了索引。

【问题】 什么是MySQL的回表?

【参考答案】 回表(Return to Table)是指在使用二级索引(非聚簇索引)进行查询时,由于二级索引的叶子节点只存储了索引列的值和对应的主键值,而没有存储完整的行数据,因此当查询需要获取索引列以外的其他列时,需要根据二级索引中获取的主键值,再到聚簇索引(主键索引)中查找完整的行记录,这个过程称为回表。回表操作会增加额外的I/O开销,因为需要两次索引扫描:先扫描二级索引找到主键,再扫描聚簇索引获取行数据。如果查询需要回表的行数较多,性能会显著下降。在某些情况下,MySQL优化器可能认为回表代价过高而选择直接进行全表扫描(即只使用聚簇索引扫描整个表)。

在InnoDB存储引擎中,聚簇索引的叶子节点直接存储整行数据,因此通过聚簇索引查询可以直接获取所有列,无需回表。而每个二级索引的叶子节点存储的是索引列的值和主键值(对于InnoDB)或行指针(对于MyISAM,但MyISAM没有聚簇索引的概念)。所以,回表特指InnoDB中二级索引查询后需要再次访问聚簇索引的行为。

【大白话解释于举例说明】 想象你有一个巨大的图书馆,里面有成千上万本书。图书馆有两种卡片目录:

- 一种是按书名排序的目录(相当于二级索引),卡片上写着书名和书的唯一编号(主键),以及书所在的书架位置信息(实际上在InnoDB中,卡片上只有编号,位置需要通过编号再查)。

- 另一种是按编号排序的目录(相当于聚簇索引),卡片上详细记录了书的完整信息,包括作者、出版社、内容简介等,并且编号就是书在书架上的实际位置(聚簇索引的叶子节点就是书本身)。

现在你想找一本名字叫《Java编程思想》的书,并且想知道它的作者和出版社。你首先去书名目录(二级索引)找到“Java编程思想”这张卡片,卡片上只有书名和书的编号(比如#12345)。然后你拿着这个编号#12345去编号目录(聚簇索引)查找,找到编号#12345的卡片,上面详细记录了作者、出版社等信息。这个拿着编号再去查详细信息的步骤,就是“回表”。

如果你只需要书名(即索引本身包含的列),那么你在书名目录上就能直接得到答案,无需再去查编号目录。这就是“覆盖索引”的场景。

再举一个SQL例子: 表user有字段id(主键)、name、age,并在name上建立了普通索引。 查询SELECT name, age FROM user WHERE name = '张三'; 执行过程:

- 通过

name索引找到所有name='张三'的索引项,每个索引项包含name和对应的id。 - 对于每个索引项,根据

id到聚簇索引(主键索引)中查找完整的行数据,从中取出age字段。 - 返回结果。 这里

age不在name索引中,所以需要回表。如果查询改为SELECT name FROM user WHERE name = '张三';,因为name索引已经包含了name列,就不需要回表,这是覆盖索引。

【扩展知识点详解】

回表产生的根本原因

InnoDB采用聚簇索引组织数据,数据行存储在聚簇索引的叶子节点上。二级索引只存储索引列和主键值,不存储其他列。因此,当查询需要的数据列超出了二级索引的范围时,就必须通过主键回表获取缺失的数据。- 回表对性能的影响

- 回表意味着额外的I/O操作,尤其是当需要回表的行数很多时,会产生大量随机I/O,因为二级索引和聚簇索引的数据页可能分散在不同的磁盘位置。

- 如果回表次数过多,MySQL优化器可能认为全表扫描(即直接扫描聚簇索引)更高效,从而放弃使用二级索引。

- 回表次数取决于索引选择性和查询条件。例如,范围查询可能导致大量回表。

- 如何避免或减少回表

- 使用覆盖索引:设计索引时,尽量将查询中需要返回的列都包含在索引中,这样查询可以直接从索引获取所有数据,无需回表。例如,对于高频查询

SELECT name, age FROM user WHERE name = ?,可以创建联合索引(name, age)。 - 使用索引下推(ICP):虽然不能完全避免回表,但ICP可以在回表前通过索引列条件过滤掉部分记录,减少回表次数。

- 合理设计索引:避免创建过多的索引,但针对关键查询建立合适的联合索引。

- 限制返回行数:通过

LIMIT减少回表次数。 - 使用主键查询:直接通过主键查询无需回表。

- 使用覆盖索引:设计索引时,尽量将查询中需要返回的列都包含在索引中,这样查询可以直接从索引获取所有数据,无需回表。例如,对于高频查询

回表与索引选择

MySQL优化器在选择索引时,会评估使用索引的成本,包括回表的代价。如果优化器估计需要回表的行数占全表比例较高(通常超过20%-30%),可能会选择全表扫描。因此,了解回表成本对于分析查询性能至关重要。- 回表在不同存储引擎中的表现

- InnoDB:聚簇索引+二级索引,回表必须。

- MyISAM:索引和数据分离,索引叶子节点存储行数据的物理地址(指针),因此使用任何索引都需要根据地址直接读取数据行,这本质上也是一种“回表”,但由于MyISAM没有聚簇索引的概念,其所有索引都是非聚簇的,且索引中直接包含行地址,所以通常不特别称为“回表”,但同样有随机I/O问题。

- Memory引擎:默认使用哈希索引,数据按行存储,索引指向数据位置,类似MyISAM。

- 如何判断查询是否发生了回表

使用EXPLAIN分析查询:- 如果

key列使用了二级索引,且Extra列没有Using index,则说明发生了回表(因为需要回表获取未包含在索引中的列)。 - 如果

Extra列显示Using index,表示使用了覆盖索引,无需回表。 - 如果

Extra列显示Using index condition,表示使用了索引下推,但仍然需要回表(但回表前过滤了一部分)。 - 如果

type列为ALL,表示全表扫描,没有使用索引。

- 如果

回表与主键长度

二级索引的叶子节点存储主键值,因此主键的长度会影响二级索引的大小。使用较短的整数主键(如自增int)比使用长字符串主键(如UUID)更节省空间,从而减少I/O。回表与多版本并发控制(MVCC)

在可重复读隔离级别下,回表读取数据时可能需要根据undo log构建旧版本,增加额外开销,但这是另一层面的问题。- 实际案例分析

假设有表t,联合索引(a, b),查询SELECT a, b, c FROM t WHERE a = 1。- 如果

c不在索引中,则需要回表获取c,EXPLAIN会显示key为(a,b),Extra可能为空或Using where(取决于是否有其他条件)。 - 如果将索引改为

(a, b, c),则查询SELECT a, b, c成为覆盖索引,Extra显示Using index,无需回表。

- 如果

- 回表与JOIN查询

在多表连接中,驱动表使用索引查找后,对每行结果可能需要回表获取完整数据再与被驱动表连接,同样需要考虑回表成本。

总结:回表是InnoDB索引机制下的必然现象,理解回表有助于设计高效的索引和编写高性能SQL。通过覆盖索引、索引下推、合理查询等手段可以有效减少回表带来的性能损耗。

【问题】 为什么 MySQL 索引用的是 B+ 树而不是红黑树?

【参考答案】 MySQL 选择 B+ 树而非红黑树,核心原因是 磁盘 I/O 效率:

- 树的高度差异:B+ 树是多路平衡树,每个节点可存储数百个键,3 层 B+ 树就能存储千万级数据。红黑树是二叉树,同样数据量树高远大于 B+ 树,意味着更多次磁盘 I/O。

- 磁盘预读特性:操作系统按页读取磁盘。B+ 树的节点大小与页对齐,一次 I/O 能读取整个节点。红黑树节点小且分散,无法利用预读。

- 范围查询:B+ 树叶子节点通过链表连接,范围查询只需遍历链表。红黑树需中序遍历,效率低。

- 缓存友好:B+ 树内部节点只存键值,单个节点能容纳更多键,缓存命中率更高。

【大白话解释】 查找数据就像在一栋楼里找人。B+ 树是大办公楼,每层有很多房间,3 层楼就能管理几千万人,你最多坐 3 次电梯就能找到人。红黑树是小别墅,每层只有左右两间房,同样人数需要盖几十层楼,你得坐几十次电梯。

【扩展知识点详解】

- 与 B 树对比:B 树每个节点都存数据,内部节点能容纳的键数更少,树更高。

- 与 LSM 树对比:LSM 树适合写多读少场景(如 RocksDB),B+ 树更适合读多写少。

- 与跳表对比:跳表实现简单,但磁盘场景下树高不可控,不适合数据库索引。

【问题】 MySQL 三层 B+ 树能存多少数据?

【参考答案】 InnoDB 中 B+ 树每个节点对应一个数据页,默认 16KB。估算过程:

- 非叶子节点:假设主键 BIGINT(8 字节),指针 6 字节,一个节点约存

16KB / (8+6) ≈ 1170个键值对。 - 叶子节点:假设每行约 1KB,一个叶子页存约 16 行。

- 三层 B+ 树:

1170 × 1170 × 16 ≈ 2190 万行。

因此,三层 B+ 树在常见场景下可存储约 2000 万行 数据。

【大白话解释】 想象一个三层办公楼:一楼大厅有 1170 个门牌指引,二楼每个房间又有 1170 个指引,三楼每个房间存 16 条记录。总共能存约 2190 万条。每次查找最多走 3 层(3 次磁盘 I/O),速度非常快。

【扩展知识点详解】

- 行大小影响:如果每行只有 100 字节,三层 B+ 树可存约 2 亿行;如果每行 8KB,则只能存约 270 万行。

- 索引层数与性能:3 层意味着最多 3 次磁盘 I/O,通常在毫秒级完成。4 层则翻倍。

- 实际查看:可通过

SHOW TABLE STATUS或innodb_table_stats获取更精确的估算。

缓冲池

【问题】 什么是MySQL缓冲池?

【参考答案】 MySQL的缓冲池(Buffer Pool)是InnoDB存储引擎中一块重要的内存区域,主要用于缓存磁盘上的数据页和索引页,以减少磁盘I/O,提升数据库的读写性能。缓冲池是InnoDB缓存机制的核心,其作用和工作原理如下:

- 核心作用:

- 缓存数据页:当读取数据时,首先从缓冲池中查找,若命中则直接返回,否则从磁盘加载到缓冲池。

- 缓存索引页:加速索引查找,减少磁盘访问。

- 管理脏页:对数据的修改先在缓冲池中的页上进行(标记为脏页),然后由后台线程异步刷新到磁盘,实现写优化。

- 通过LRU(最近最少使用)算法管理缓存页的淘汰,确保热数据常驻内存。

- 内部结构: InnoDB通过三个关键链表管理缓冲池中的内存页:

- Free List(空闲链表):记录当前空闲的缓存页,用于存放从磁盘新加载的数据页。

- LRU List(LRU链表):管理已被使用的缓存页,按最近最少使用的顺序排序。InnoDB对LRU进行了优化,将链表分为年轻代(young sublist)和老年代(old sublist),避免全表扫描污染热数据。

- Flush List(脏页链表):记录所有被修改但未刷入磁盘的脏页,按最早修改时间排序,便于后台线程刷盘。

- 工作流程:

- 读操作:根据表空间ID和页号通过哈希表查找页是否在缓冲池中。若在,则直接使用并根据LRU策略调整位置;若不在,从Free List获取空闲页(若Free List为空,则淘汰LRU List尾部的一个页,若该页为脏页则先加入Flush List或刷盘),然后从磁盘加载数据页放入LRU List的老年代头部。

- 写操作:直接在缓冲池的页上修改,标记为脏页并加入Flush List(如果不在其中)。同时,该页被移动到LRU List的年轻代头部。

- 刷盘:后台线程(Page Cleaner)定期将Flush List中的脏页刷新到磁盘,并清理LRU List中符合条件的页以维持空闲页。

缓冲池的大小通过参数innodb_buffer_pool_size配置,是影响MySQL性能的关键因素。合理设置缓冲池大小可显著提升数据库并发处理能力和响应速度。

【大白话解释于举例说明】 可以把缓冲池想象成你办公桌上的常用文件抽屉。所有工作文件都存放在远处的文件柜里(磁盘),每次取文件都要走过去,很费时间。为了提高效率,你在办公桌上放一个抽屉(缓冲池),把经常用的文件放在里面。

- Free List:抽屉里空白的文件夹,准备放新文件。

- LRU List:抽屉里文件的摆放顺序。最常用的放在最上面(年轻代),不常用的压在下面(老年代)。当抽屉满了需要放新文件时,就会把最下面最不常用的文件扔掉(淘汰),腾出空间。

- Flush List:记录你修改过的文件清单。你在文件上做了笔记(修改),还没放回文件柜,需要记下来等有空时统一放回(刷盘)。

例如,执行SELECT * FROM user WHERE id=1时,MySQL先在缓冲池中找id=1的数据页。如果找到直接返回;如果没找到,从磁盘加载该页到缓冲池,放入LRU链表的老年代头部,然后返回数据。执行UPDATE user SET name='张三' WHERE id=1时,直接在缓冲池中修改该页,标记为脏页并加入Flush List,同时该页被移动到LRU链表的年轻代头部。之后,后台线程会在适当时机将脏页写回磁盘。

【扩展知识点详解】

- 缓冲池的组成结构

- 数据页(Page):缓冲池以页为单位管理,默认16KB。每个页对应磁盘上的一个数据页。

- 控制块(Control Block):每个缓存页有一个控制块,记录元数据(如表空间ID、页号、LRU指针、脏页标志等),控制块本身也占用内存。

- 哈希表:根据(space_id, page_no)快速定位页是否在缓冲池中。

- 链表:Free List、LRU List、Flush List均为双向链表,通过控制块中的指针连接。

- LRU算法的优化(Midpoint Insertion Strategy)

- 传统LRU可能因全表扫描导致热数据被淘汰。InnoDB将LRU List分为两部分:

- Young sublist(年轻代):占5/8,存放频繁访问的热数据。

- Old sublist(老年代):占3/8,存放新加载或偶尔访问的数据。

- 新读取的页总是插入到Old sublist的头部,只有再次被访问时才会被移动到Young sublist头部。参数

innodb_old_blocks_time可设置页在Old区域停留的最短时间,防止短时热点被误移。

- 传统LRU可能因全表扫描导致热数据被淘汰。InnoDB将LRU List分为两部分:

- 关键参数

innodb_buffer_pool_size:缓冲池总大小,建议设为物理内存的50%-70%。innodb_buffer_pool_instances:将缓冲池划分为多个实例,减少锁竞争。innodb_old_blocks_pct:Old区域占比,默认37(即3/8)。innodb_old_blocks_time:页在Old区域的最短停留时间(毫秒),默认1000。innodb_max_dirty_pages_pct:脏页比例上限,默认75%,超过则强制刷盘。innodb_io_capacity:后台刷盘的最大I/O能力。

- 缓冲池对性能的影响

- 读性能:热数据常驻内存,避免磁盘I/O。

- 写性能:写操作先修改内存,异步刷盘,减少写延迟。

- 磁盘负载:合并多次写操作,减少随机I/O。

- 内存占用:过大会导致操作系统内存换页,过小则频繁缺页。

- 监控与分析

SHOW ENGINE INNODB STATUS:查看缓冲池命中率、链表长度、脏页数量等。INNODB_BUFFER_POOL_STATS表:提供详细的统计信息(如读请求次数、磁盘读取次数)。- 命中率计算公式:

(innodb_buffer_pool_read_requests - innodb_buffer_pool_reads) / innodb_buffer_pool_read_requests。

预读机制

InnoDB根据访问模式提前将相邻页加载到缓冲池,包括线性预读和随机预读,由参数innodb_read_ahead_threshold控制。Checkpoint与刷盘

Checkpoint机制推进重做日志的复用,并触发脏页刷盘。缓冲池中的Flush List是Checkpoint刷盘的主要依据。后台线程根据LSN(日志序列号)顺序刷新脏页。与双写缓冲区的关系

双写缓冲区(Doublewrite Buffer)是InnoDB为保证数据页写入原子性而引入的机制,位于共享表空间,与缓冲池协同工作但独立于缓冲池。缓冲池预热

重启后可通过innodb_buffer_pool_load_at_startup自动加载先前保存的缓冲池内容,或手动执行SELECT ...进行预热。- 常见问题

- 缓冲池污染:全表扫描可能将热数据挤出,通过LRU冷热分离和

innodb_old_blocks_time避免。 - 内存碎片:频繁分配释放可能导致碎片,可通过调整实例数量和页大小优化。

- 并发竞争:多实例可缓解锁竞争,但需均衡配置。

- 缓冲池污染:全表扫描可能将热数据挤出,通过LRU冷热分离和

掌握缓冲池原理是MySQL性能调优的基础,合理配置和监控能显著提升数据库的整体性能。

【问题】 MySQL 的 Change Buffer 是什么?它有什么作用?

【参考答案】 Change Buffer 是 InnoDB 针对 非唯一二级索引 的写优化机制:

- 核心作用:当对二级索引页执行 INSERT/DELETE/UPDATE 时,若目标页不在缓冲池中,InnoDB 不立即从磁盘读取,而是将变更记录在 Change Buffer 中,等将来该页被读取时再合并(Merge)。

- 适用条件:仅适用于非唯一二级索引。聚簇索引和唯一索引必须立即检查唯一性,无法延迟。

- 优势:将多次随机 I/O 合并为一次顺序 I/O,大幅减少磁盘读取次数。

- 持久化:Change Buffer 本身是 B+ 树结构,存储在系统表空间中,通过 redo log 保证持久性。

【大白话解释】 就像快递代收点:你要往不同楼层送文件,但有些楼层没上班(页不在内存)。与其每次专程跑,不如先把文件放代收点(Change Buffer),等那些楼层的人来了再一起转交。省了很多跑腿次数。

【扩展知识点详解】

- 参数:

innodb_change_buffer_max_size控制占缓冲池最大比例,默认 25%,最大 50%。 - Merge 时机:后台线程定期 Merge;查询访问该页时触发;数据库空闲时主动 Merge。

- 读多写少场景:Change Buffer 效果不明显。写多读少场景收益最大。

【问题】 MySQL 中的 Log Buffer 是什么?它有什么作用?

【参考答案】 Log Buffer 是 InnoDB 中缓存 redo log 记录的内存区域:

- 核心作用:事务产生的 redo log 先写入 Log Buffer,再由后台线程刷入磁盘。通过批量刷盘减少磁盘 I/O。

- 刷盘策略:由

innodb_flush_log_at_trx_commit控制:- 0:每秒刷盘一次(可能丢失 1 秒数据)。

- 1:每次事务提交都刷盘(最安全,默认)。

- 2:每次提交写入 os 缓存,每秒 fsync(os 崩溃可能丢数据)。

【大白话解释】 Log Buffer 像餐厅的点单缓冲板。服务员先把订单写在缓冲板上,不是每来一单就冲进厨房。=1 像要求每单立即送进厨房,最安全但最累;=0 像每分钟统一送一次,效率高但可能丢单。

【扩展知识点详解】

- 大小设置:

innodb_log_buffer_size默认 16MB,大事务可适当增大。 - 与 binlog 区别:Log Buffer 缓存 redo log(引擎层物理日志),binlog cache 缓存 binlog(Server 层逻辑日志)。

- 组提交:多个事务的 redo log 可合并为一次 fsync,提高 I/O 效率。

【问题】 MySQL 的 Doublewrite Buffer 是什么?它有什么作用?

【参考答案】 Doublewrite Buffer(双写缓冲)是 InnoDB 为解决 页断裂(Partial Page Write) 的机制:

- 问题背景:InnoDB 数据页 16KB,而操作系统磁盘 I/O 最小单位 4KB。写 16KB 时宕机可能只有部分扇区写入,导致数据页损坏。redo log 记录的是“对某页的修改”,无法修复不完整的页。

- 工作流程:

- 刷脏页时,先将页副本 顺序写入 Doublewrite Buffer(系统表空间 2MB 连续空间)。

- 再将数据页 随机写入 实际数据文件。

- 恢复时先从 Doublewrite Buffer 找到完整页副本恢复,再应用 redo log。

【大白话解释】 就像寄重要包裹,先复印一份(写入 Doublewrite),再把原件寄出去。如果寄的过程中包裹被毁(页断裂),还有复印件可以恢复。redo log 只记了“在包裹上加标签”,没法还原被毁的包裹本身。

【扩展知识点详解】

- 性能影响:增加一次顺序写(约 2MB),性能损耗通常 5%-10%。

- 关闭:MySQL 8.0 可通过

innodb_doublewrite=OFF关闭(不推荐)。 - 与 redo log 配合:恢复流程——先从 Doublewrite 恢复完整页,再应用 redo log,缺一不可。

执行计划

【问题】 讲一下执行计划EXPLAIN?

【参考答案】 EXPLAIN是MySQL提供的一条用于分析查询语句执行计划的命令。通过在SELECT、DELETE、INSERT、REPLACE、UPDATE等语句前加上EXPLAIN关键字,MySQL会返回关于查询执行步骤的详细信息,包括表的读取顺序、索引使用情况、连接类型、扫描行数等,帮助开发者理解查询的性能瓶颈并进行优化。

EXPLAIN的输出结果包含多个字段,每个字段都有特定的含义:

- id:查询中每个SELECT子句的标识符,id越大越先执行,相同id则从上到下执行。

- select_type:查询的类型,如SIMPLE(简单查询)、PRIMARY(主查询)、SUBQUERY(子查询)、DERIVED(派生表)、UNION(联合查询)等。

- table:当前行所访问的表。

- partitions:匹配的分区(如果表分区)。

- type:访问类型,反映查询的效率,从好到坏依次为:system > const > eq_ref > ref > fulltext > ref_or_null > index_merge > unique_subquery > index_subquery > range > index > ALL。实际常见的重要类型有:

- system:表只有一行(系统表),是const的特例。

- const:通过主键或唯一索引等值查询,最多返回一行。

- eq_ref:连接查询中,被驱动表通过主键或唯一索引等值访问,常用于连接条件。

- ref:使用非唯一索引或唯一索引的前缀进行等值查询,可能返回多行。

- range:索引范围扫描,如

BETWEEN、>、<、IN()等。 - index:全索引扫描,即遍历整个索引树(比全表扫描快,因为索引通常较小)。

- ALL:全表扫描,性能最差。

- possible_keys:可能用到的索引(一个或多个)。

- key:实际使用的索引,若为NULL则表示未使用索引。

- key_len:实际使用的索引的最大字节长度,可推断查询使用了联合索引中的哪些列。

- ref:显示哪些列或常量与key一起用于从表中选择行,常见值有

const(常量)、列名(如db.table.col)等。 - rows:MySQL估计需要扫描的行数(不是精确值)。

- filtered:表示返回结果的行数占扫描行数的百分比(估计值),最大100。

- Extra:包含额外的执行信息,常见重要值有:

- Using index:使用了覆盖索引,无需回表。

- Using where:使用了WHERE条件过滤,但可能是在存储引擎层或Server层。

- Using index condition:使用了索引下推(ICP)。

- Using temporary:使用了临时表(通常由于GROUP BY或ORDER BY)。

- Using filesort:使用了文件排序(无法利用索引排序)。

- Impossible WHERE:WHERE条件永远为假。

- Select tables optimized away:优化器确定无需访问表(如聚合函数查询)。

通过分析EXPLAIN的输出,可以识别全表扫描、索引未命中、排序效率低等问题,从而针对性地创建或调整索引、优化SQL语句。

【大白话解释于举例说明】 可以把EXPLAIN想象成一个导航软件的“路线预览”。当你输入一个目的地(查询),导航会告诉你:先走哪条路(表的读取顺序),是否走高速(索引),路上有几个红绿灯(扫描行数),以及最终到达的方式(type)。例如:

- type=ALL:就像导航说“没有高速,只能走普通道路,全程50公里”,意味着全表扫描,速度慢。

- type=ref:导航说“走高速,但高速出口有好几个”,相当于用了非唯一索引,可能匹配多行。

- type=const:导航说“直达,只有一个出口”,表示通过唯一索引精确定位。

- Extra=Using index:导航说“全程高速直达,无需下高速”,表示覆盖索引,直接在索引中就拿到了所有数据。

- Extra=Using filesort:导航说“需要重新规划路线,因为下高速后要掉头”,意味着无法利用索引排序,需要额外排序。

假设我们有表user,主键id,普通索引name,执行:

1

EXPLAIN SELECT * FROM user WHERE name = '张三';

输出可能显示type=ref,key=name,rows=1,Extra=Using index condition(如果还有别的条件)或Using where。这告诉我们:查询用了name索引,但需要回表获取其他字段,并且通过索引下推可能过滤了一部分数据。

【扩展知识点详解】

- type字段详解(按性能从高到低)

- system:表只有一行记录,是const的特例,一般不会出现。

- const:最多匹配一行,如主键或唯一索引等值查询。

- eq_ref:出现在多表连接时,被驱动表使用主键或唯一索引连接,且驱动表每行只匹配被驱动表一行。

- ref:非唯一索引等值查询,或唯一索引的前缀匹配。

- fulltext:使用全文索引。

- ref_or_null:类似ref,但额外搜索包含NULL值的行。

- index_merge:使用索引合并优化(多个索引合并使用)。

- unique_subquery:子查询中使用唯一索引。

- index_subquery:子查询中使用普通索引。

- range:索引范围扫描,如

>、<、BETWEEN、IN等。 - index:全索引扫描,遍历整个索引树,但通常比全表扫描快。

- ALL:全表扫描。

- key_len的计算

key_len表示索引使用的字节数,可用于判断联合索引实际使用了多少列。计算方法:- 字符集:utf8mb4每个字符占4字节,utf8占3字节,gbk占2字节。

- 变长字段(如varchar)需要额外2字节存储长度。

- 允许NULL的字段需要额外1字节标记NULL。

例如,varchar(10) NOT NULL在utf8mb4下,最大长度为10*4 + 2 = 42字节。若查询使用了该列,key_len为42。

- rows与filtered的用途

- rows:优化器估算需要读取的行数,反映了索引选择性。

- filtered:表示经过WHERE条件过滤后剩余行数的百分比。例如rows=100,filtered=10,则预计返回10行。结合rows*filtered可估算最终结果集大小。

- EXPLAIN的扩展形式

- EXPLAIN FORMAT=JSON:以JSON格式输出更详细的信息,包括成本估算、索引条件等。

- EXPLAIN EXTENDED(MySQL 5.6前)和 EXPLAIN PARTITIONS(5.1前)已被整合进标准EXPLAIN。

- SHOW WARNINGS 可显示优化器重写后的查询。

- EXPLAIN的局限性

- 执行计划是基于当前统计信息的估算,实际执行可能因缓存、并发等不同。

- 不显示触发器、存储过程的影响。

- 对于复杂的存储过程或函数,EXPLAIN可能无法深入内部。

- 如何利用EXPLAIN优化查询

- 关注type是否为ALL或index,如果是,考虑添加或调整索引。

- 检查key是否为NULL,possible_keys是否有可用索引未被使用。

- 查看key_len是否充分利用了联合索引。

- 检查Extra中是否有Using filesort或Using temporary,考虑优化排序或分组字段的索引。

- 对比rows与实际返回行数,若差距过大,可能统计信息过旧(需ANALYZE TABLE)。

- 对于连接查询,确保被驱动表的连接列有索引,且type为eq_ref或ref。

- 实战案例

假设有联合索引(a, b, c),查询SELECT * FROM t WHERE a=1 AND c=2,EXPLAIN可能显示key_len只包含a的长度(如4字节),说明只用了a列,c列未用索引,Extra可能显示Using where。此时若想进一步优化,可考虑将索引改为(a, c, b)或(a, b, c)并利用索引下推,或创建覆盖索引(a, c)。

掌握EXPLAIN是SQL调优的基础,结合慢查询日志和性能监控,可以系统地提升MySQL查询效率。

主从复制

【问题】 MySQL主从复制的流程是什么?

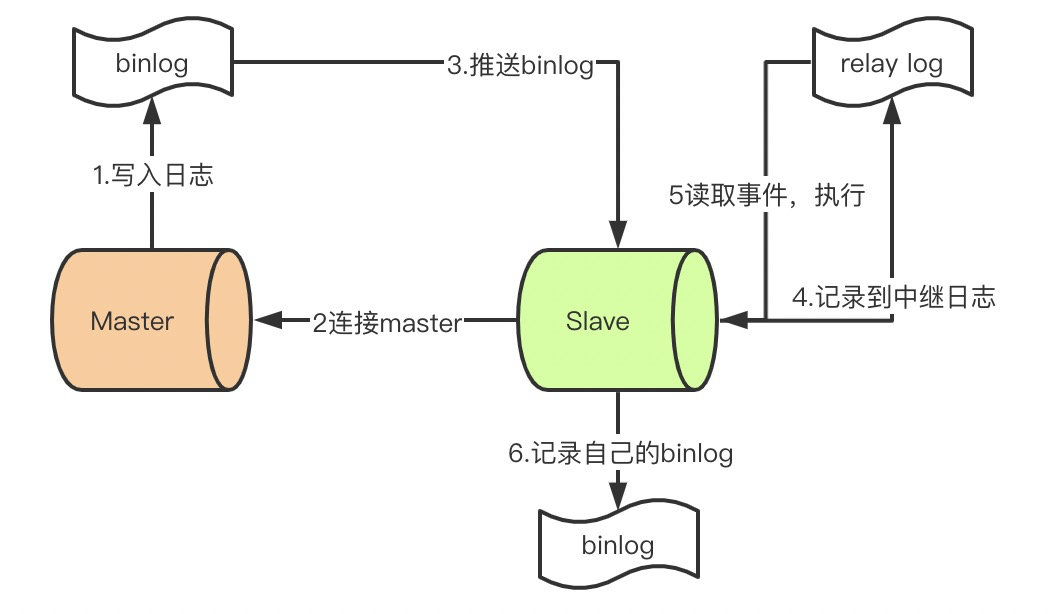

【参考答案】 MySQL主从复制是一种基于二进制日志(binlog)的数据同步机制,其核心流程可概括为三个步骤:主库记录变更、从库拉取日志、从库重放日志。具体流程如下:

- 主库记录二进制日志

- 当主库上的事务提交(或准备提交)时,会将数据变更写入二进制日志(binlog)文件。

- 在写入binlog前,主库会生成一个dump线程,用于后续向从库发送binlog事件。

- binlog的写入与事务的提交顺序一致,确保了复制的一致性。

- 从库I/O线程拉取日志

- 从库启动一个I/O线程,连接到主库,请求从指定的binlog文件名和位置开始同步。

- 主库的dump线程负责读取binlog事件,并发送给从库的I/O线程。

- 从库I/O线程将接收到的binlog事件写入本地的中继日志(relay log)文件。

- 从库SQL线程重放日志

- 从库启动一个SQL线程(或多个SQL线程,若启用并行复制),持续读取中继日志中的事件并顺序执行。

- SQL线程将事件在从库上重放,更新从库数据,使其与主库保持一致。

- 执行完成后,从库可以选择记录自己的二进制日志(若

log_slave_updates开启),以便作为其他从库的主库。

整个过程是异步的,即主库提交事务后不会等待从库确认,但可以通过配置半同步复制来保证至少一个从库收到日志。此外,从库也可以开启并行复制(MySQL 5.7+)以提高重放效率。

【大白话解释于举例说明】 可以把主从复制想象成一个“课堂笔记”的传递过程:

- 主库是老师,在课堂上讲课并写在黑板上(binlog记录变更)。

- 从库是学生,需要记笔记来复习。

- 学生派了一个人(I/O线程)专门去抄老师的板书:这个人站在讲台边,老师每写一条(binlog事件),他就抄下来(写入自己的笔记本,即relay log)。这个过程中,老师不会等学生抄完才继续讲课(异步)。

- 学生还有另一个人(SQL线程)负责朗读笔记本上的内容并理解(执行SQL),从而记住知识点(更新数据)。如果学生想当小老师(作为其他从库的主库),他还可以在自己的笔记本上再整理一份笔记(记录自己的binlog)。

再举个例子:一个电商网站的主库处理订单,从库用于报表查询。当用户下单时,主库插入一条订单记录,并写入binlog。从库I/O线程立即拉取这条binlog,写入relay log,SQL线程随后执行插入,这样从库就有了新订单数据,报表查询就能看到最新数据(尽管可能有轻微延迟)。

【扩展知识点详解】

- 主从复制的目的

- 读写分离:主库处理写操作,从库处理读操作,提升并发能力。

- 数据备份:从库可作为热备份,防止主库故障。

- 高可用:配合故障转移工具(如MHA、Orchestrator)实现主从切换。

- 数据分析:从库可承担复杂查询,避免影响主库性能。

- 二进制日志(binlog)格式

- STATEMENT:记录原始SQL语句,优点是日志量小,缺点是不确定性函数(如UUID())可能导致数据不一致。

- ROW:记录每行数据的变更,优点是最精确,缺点是日志量大。

- MIXED:混合模式,默认使用STATEMENT,对于不确定语句自动转为ROW。

- 复制类型

- 异步复制:默认方式,主库提交事务后立即返回,不等待从库确认。

- 半同步复制:主库等待至少一个从库收到binlog(写入relay log)后才提交事务,需安装插件

rpl_semi_sync_master和rpl_semi_sync_slave。 - 同步复制:主库等待所有从库执行完毕才提交,性能差,MySQL未实现(可用Group Replication或Galera Cluster)。

- GTID复制

- GTID(全局事务标识符)为每个事务分配唯一ID,简化复制管理和故障转移。基于GTID的复制无需指定binlog文件名和位置,自动定位。

- 并行复制

- MySQL 5.6引入基于库级别的并行复制(不同库的事务可并行)。

- MySQL 5.7引入基于逻辑时钟的并行复制(同一库内事务可并行,但需满足提交顺序)。

- MySQL 8.0进一步优化,支持基于WRITESET的并行复制,提高并发度。

- 复制拓扑

- 一主一从:基础架构。

- 一主多从:常见读写分离。

- 主主复制:互为主从,需避免冲突(一般用于特殊场景)。

- 级联复制:从库再作为其他从库的主库,减轻主库压力。

- 常见问题与优化

- 复制延迟:主库写压力大、从库SQL线程慢、大事务等导致。解决方案:并行复制、优化SQL、拆分大事务。

- 数据一致性:异步复制可能丢数据,半同步复制可缓解。

- 主从切换:需确保数据一致,使用GTID或

master_pos_wait等工具。 - 从库binlog:若从库开启

log_slave_updates,则会记录从库执行的变更,用于链式复制。

- 监控复制状态

SHOW SLAVE STATUS\G:查看从库复制状态,关键字段:Slave_IO_Running、Slave_SQL_Running、Seconds_Behind_Master(延迟秒数)。SHOW MASTER STATUS:查看主库binlog信息。- 通过

performance_schema表(如replication_applier_status)获取更详细统计。

- 复制过滤

- 可在从库配置

replicate-do-db、replicate-ignore-table等规则,过滤不需要复制的数据库或表。

- 可在从库配置

- 安全性考虑

- 主从复制需使用具有

REPLICATION SLAVE权限的用户。 - 建议开启SSL加密复制流量。

- 从库应避免直接写入,防止数据不一致。

- 主从复制需使用具有

理解主从复制流程是MySQL高可用架构的基础,合理配置可提升系统稳定性和扩展性。

【问题】 如何在 MySQL 中避免单点故障?

【参考答案】 避免 MySQL 单点故障的核心策略:

- 主从复制:部署一主多从架构,从库作为热备份。主库故障时将从库提升为主库。

- 半同步复制:确保至少一个从库收到 binlog 后主库才返回成功,减少数据丢失风险。

- 高可用中间件:

- MHA:自动主从切换,切换时间 10-30 秒。

- Orchestrator:GitHub 开源,支持自动故障检测和拓扑重构。

- MySQL InnoDB Cluster:MySQL 官方方案,基于 Group Replication + MySQL Router + MySQL Shell。

- VIP 漂移:应用连接 VIP,主库故障时 VIP 漂移到新主库,应用无感知。

- 多机房部署:跨机房部署从库,防止单机房故障。

- 定期备份:全量 + 增量备份,确保极端情况下可恢复数据。

【大白话解释】 避免单点故障就像不能把所有鸡蛋放在一个篮子里:主库是主篮子,从库是备用篮子;MHA 是自动换篮子的机器人;VIP 是贴在当前篮子上的标签,换篮子时标签自动移过去。

【扩展知识点详解】

- MHA 原理:监控主库状态,故障时从多个从库中选择数据最新的提升为主库,其他从库重新指向新主库。

- Group Replication:基于 Paxos 协议的多主复制,自动冲突检测,但性能不如异步复制。

- 云服务方案:AWS RDS Multi-AZ、阿里云 RDS 高可用版等,底层自动实现故障切换。

【问题】 如何在 MySQL 中实现读写分离?

【参考答案】 MySQL 读写分离的实现方案:

- 基于主从复制:主库处理写操作,从库处理读操作。核心前提是主从复制已搭建完成。

- 实现方式:

- 代码层面:在应用中配置主库和从库数据源,写操作路由到主库,读操作路由到从库。使用 Spring 的

@Transactional(readOnly=true)区分。 - 中间件代理:

- ShardingSphere-Proxy:代理层自动路由读写。

- ProxySQL:高性能 MySQL 代理,支持读写分离和查询路由。

- MyCAT:国产中间件,支持读写分离。

- MySQL Router:官方轻量级路由器,配合 InnoDB Cluster 使用。

- 代码层面:在应用中配置主库和从库数据源,写操作路由到主库,读操作路由到从库。使用 Spring 的

- 复制延迟处理:

- 关键读操作走主库(强制路由)。

- 从库延迟检测,延迟超阈值时读请求切换到主库。

【大白话解释】 读写分离就像图书馆的借还窗口:主库是总服务台(处理新增/修改/删除),从库是自助查询机(只看数据)。写操作必须去总服务台,读操作去自助查询机,减轻总服务台压力。

【扩展知识点详解】

- Spring 集成:

AbstractRoutingDataSource动态切换数据源;或使用 ShardingSphere-JDBC 的读写分离配置。 - 事务中的读:事务内的读操作应走主库,保证一致性(避免幻读)。

- 多从库负载均衡:中间件支持轮询、权重等策略分配读请求到不同从库。

【问题】 如何处理 MySQL 的主从同步延迟?

【参考答案】 主从同步延迟的常见原因和处理方案:

- 原因分析:

- 主库并行写入,从库单线程重放(5.7 之前)。

- 大事务产生大量 binlog,重放耗时长。

- 从库硬件性能不足或负载过高。

- 网络延迟导致 binlog 传输慢。

- 解决方案:

- 并行复制:MySQL 5.7+ 开启基于组提交的并行复制(

slave_parallel_workers)。 - 拆分大事务:将大事务拆为小事务,减少单次重放时间。

- 从库升级硬件:SSD、更多内存、更强 CPU。

- 半同步复制:确保至少一个从库实时同步。

- 读写分离优化:关键读操作走主库;检测延迟超阈值时自动切主库。

- 并行复制:MySQL 5.7+ 开启基于组提交的并行复制(

- 监控:

SHOW SLAVE STATUS中的Seconds_Behind_Master;或使用pt-heartbeat工具更精确监控。

【大白话解释】 主从延迟就像老师讲课(主库写入)和记笔记(从库重放)的时间差。老师可以同时讲多个知识点(并行写入),但记笔记只能一个字一个字记(串行重放),所以越落越多。解决办法是让多个人一起记笔记(并行复制),或者老师讲慢点(拆分大事务)。

【扩展知识点详解】

- pt-heartbeat:Percona 工具,比

Seconds_Behind_Master更准确,实际测量主从延迟。 - MySQL 8.0 并行复制:基于 WRITESET 的并行复制,进一步提升并发度。

- 延迟从库:故意配置延迟的从库(如延迟 1 小时),用于误操作数据恢复。

【问题】 如何实现数据库的不停服迁移?

【参考答案】 数据库不停服迁移的核心思路是 双写 + 逐步切流:

- 全量数据同步:使用工具(如 DataX、Canal、DTS)将旧库全量数据同步到新库。

- 增量同步:通过解析 binlog(如 Canal)实时同步增量数据到新库。

- 双写验证:应用同时写入新旧库,但只从旧库读取。对比新旧库数据一致性。

- 灰度切流:逐步将读请求切换到新库(1% → 10% → 50% → 100%),验证无误后全量切读。

- 切写:最后将写请求切换到新库,关闭旧库双写。

- 回滚方案:任何阶段出问题都可切回旧库,因为旧库始终有完整数据。

【大白话解释】 不停服迁移就像搬家:先把所有东西复制一份到新房(全量同步);之后旧房每天新增的东西也同步到新房(增量同步);然后在两边同时放东西(双写);先去新房看一眼确认没问题(灰度切读);最后正式住进去(切写)。

【扩展知识点详解】

- Canal:阿里开源的 binlog 增量同步工具,支持 MySQL → MySQL、MySQL → ES 等。

- DTS:云数据库迁移服务(阿里云/AWS),支持不停服迁移。

- 数据校验:迁移后使用 pt-table-checksum 和 pt-table-sync 校验和修复数据差异。

分库分表

【问题】 做过MySQL分库分表吗?多大数据量需要分表?分表方案是什么?有遇到过数据倾斜吗?

【参考答案】 分库分表是应对数据库单库单表数据量过大导致性能下降的常见解决方案。关于何时需要分表,业界常用阿里巴巴《Java开发手册》中提到的“单表行数超过500万行或单表容量超过2GB”作为参考,但实际阈值取决于硬件配置、索引大小、InnoDB缓冲池(innodb_buffer_pool_size)等因素。核心判断标准是:当索引无法完全加载到内存,导致频繁磁盘I/O,或表锁/行锁竞争激烈,或备份维护时间过长时,就需要考虑分库分表。

分库分表的方案主要分为垂直拆分和水平拆分,其中水平拆分是应对大数据量的核心手段。常见的水平分片策略包括:

- 范围分片(Range):按数据范围(如时间、ID区间)划分到不同库表。优点是实现简单,扩容方便(只需新增节点)。缺点是容易产生热点数据(如近期数据访问频繁),且数据分布可能不均。

- 哈希分片(Hash):对分片键(如用户ID)进行哈希计算,取模后路由到具体库表。优点是数据分布均匀,避免热点。缺点是扩容困难,通常需要翻倍扩容并迁移数据。

- 一致性哈希(Consistent Hashing):在哈希基础上引入虚拟节点,使得扩容时只需迁移少量数据。适合需要动态扩容的场景。

- 二次分片法:先计算总分片数(库数×表数),取模得到逻辑分片号,再通过分片号除以表数得到库索引,取模得到表索引。这种方案将库和表解耦,便于后期扩容(但翻倍扩容仍会导致数据迁移)。

- 基因法:利用分片键的某些二进制位(基因)决定分片位置,保证同一用户的数据落在同一分片,同时支持跨分片查询的基因嵌入。

- 关系表冗余法:维护一张路由表,记录分片键到具体库表的映射。优点是灵活,支持任意分片规则。缺点是路由表可能成为性能瓶颈,且需要额外维护。

- 剔除公因数法:类似二次分片,但通过数学优化减少数据迁移量。

数据倾斜是指分片后各节点数据量或访问负载差异过大,导致部分节点成为瓶颈。常见原因有:分片键选择不当(如按地区分片但部分地区数据量极大)、哈希算法不均匀、数据特征变化(如某用户数据暴增)。解决数据倾斜的方法包括:重新选择分片键、使用一致性哈希、对超大Key进行二次拆分(如分桶)、动态调整分片规则、定期分析数据分布并手动迁移等。通常用偏斜率(最大数据量-最小数据量)/最小数据量来衡量倾斜程度,一般要求控制在5%以内。

【大白话解释于举例说明】

- 为什么需要分库分表:就像图书馆的书架,如果书太多,一个书架放不下,找书会变慢(索引加载不到内存,要频繁翻硬盘)。或者大家抢同一本书(锁竞争),那就需要把书分散到多个书架(分表)甚至多个房间(分库)。

- 什么时候分:阿里巴巴说的500万行或2GB是个参考,但关键看你的书架(内存)有多大。如果书架足够大,能放下所有书的索引,再多书也能快速找;如果书架小,书一多就得频繁去仓库(磁盘)搬书,速度就慢了。

- 分表方案举例:

- 范围分片:按年份分订单表,2023年的放一张表,2024年的放另一张。优点是每年一张,清晰明了,缺点是今年是热点,大家都查今年的表,这张表压力大。

- 哈希分片:对用户ID取模,比如模8,分成8个表。优点是每个表数据差不多均匀,缺点是如果以后要增加到16个表,数据得重新分布(麻烦)。